mirror of

https://github.com/kohya-ss/sd-scripts.git

synced 2026-04-06 21:52:27 +00:00

Compare commits

424 Commits

| Author | SHA1 | Date | |

|---|---|---|---|

|

|

f037b09c2d | ||

|

|

18d69d8e5e | ||

|

|

770a56193e | ||

|

|

4627b389ff | ||

|

|

1cd07770a4 | ||

|

|

c93cbbc373 | ||

|

|

8cecc676cf | ||

|

|

ea1cf4acee | ||

|

|

cd5e3baace | ||

|

|

e76ea7cd7d | ||

|

|

d68ba2f9de | ||

|

|

5fc80b7a5b | ||

|

|

31069e1dc5 | ||

|

|

6c28dfb417 | ||

|

|

2d6faa9860 | ||

|

|

cb53a77334 | ||

|

|

4d91dc0d30 | ||

|

|

935d4774a9 | ||

|

|

24e3d4b464 | ||

|

|

b0c33a4294 | ||

|

|

bf3674c1db | ||

|

|

b996f5a6d6 | ||

|

|

472f516e7c | ||

|

|

c838efcfa8 | ||

|

|

4f70e5dca6 | ||

|

|

0138a917d8 | ||

|

|

49b29f2db2 | ||

|

|

99eaf1fd65 | ||

|

|

5fa20b5348 | ||

|

|

895b0b6ca7 | ||

|

|

238f01bc9c | ||

|

|

43a08b4061 | ||

|

|

066b1bb57e | ||

|

|

3cdae0cbd2 | ||

|

|

14891523ce | ||

|

|

559a1aeeda | ||

|

|

a18558ddfe | ||

|

|

6732df93e2 | ||

|

|

4f42f759ea | ||

|

|

c9b157b536 | ||

|

|

4c06bfad60 | ||

|

|

a35d7ef227 | ||

|

|

a4b34a9c3c | ||

|

|

5a3d564a30 | ||

|

|

4dc1124f93 | ||

|

|

9c80da6ac5 | ||

|

|

292cdb8379 | ||

|

|

5ec90990de | ||

|

|

e203270e31 | ||

|

|

b2c5b96f2a | ||

|

|

1b89b2a10e | ||

|

|

143c26e552 | ||

|

|

518a18aeff | ||

|

|

a3c7d711e4 | ||

|

|

dbadc40ec2 | ||

|

|

447c56bf50 | ||

|

|

a9b26b73e0 | ||

|

|

64c923230e | ||

|

|

795a6bd2d8 | ||

|

|

aee343a9ee | ||

|

|

2c5949c155 | ||

|

|

193674e16c | ||

|

|

4f92b6266c | ||

|

|

2d86f63e15 | ||

|

|

88751f58f6 | ||

|

|

7b324bcc3b | ||

|

|

1645698ec0 | ||

|

|

5aa5a07260 | ||

|

|

6d9f3bc0b2 | ||

|

|

1816ac3271 | ||

|

|

cca3804503 | ||

|

|

cb08fa0379 | ||

|

|

a265225972 | ||

|

|

eb66e5ebac | ||

|

|

9d4cf8b03b | ||

|

|

a167a592e2 | ||

|

|

432353185c | ||

|

|

d526f1d3d3 | ||

|

|

c219600ca0 | ||

|

|

de95431895 | ||

|

|

c86bf213d1 | ||

|

|

48c1be34f3 | ||

|

|

140b4fad43 | ||

|

|

1f7babd2c7 | ||

|

|

cfb19ad0da | ||

|

|

1214760cea | ||

|

|

64d85b2f51 | ||

|

|

8f08feb577 | ||

|

|

ec7f9bab6c | ||

|

|

83e102c691 | ||

|

|

c3f9eb10f1 | ||

|

|

563a4dc897 | ||

|

|

370ca9e8cd | ||

|

|

5dad64b684 | ||

|

|

e24a43ae0b | ||

|

|

44d4cfb453 | ||

|

|

7c1cf7f4ea | ||

|

|

0b38e663fd | ||

|

|

8b25929765 | ||

|

|

b80431de30 | ||

|

|

b177460807 | ||

|

|

c78c51c78f | ||

|

|

2652c9a66c | ||

|

|

618592c52b | ||

|

|

75d1883da6 | ||

|

|

4ad8e75291 | ||

|

|

e355b5e1d3 | ||

|

|

e3b2bb5b80 | ||

|

|

7544b38635 | ||

|

|

68cd874bb6 | ||

|

|

c4a596df9e | ||

|

|

00a9d734d9 | ||

|

|

458173da5e | ||

|

|

1932c31c66 | ||

|

|

dd05d99efd | ||

|

|

cf2bc437ec | ||

|

|

aa317d4f57 | ||

|

|

51249b1ba0 | ||

|

|

ab05be11d2 | ||

|

|

e7051d427c | ||

|

|

b885c6f9d2 | ||

|

|

ad443e172a | ||

|

|

eb68892ab1 | ||

|

|

c4b4d1cb40 | ||

|

|

82aac26469 | ||

|

|

3ce846525b | ||

|

|

8929bf31d9 | ||

|

|

87846c043f | ||

|

|

7b0af4f382 | ||

|

|

225c533279 | ||

|

|

8d5ba29363 | ||

|

|

19386df6e9 | ||

|

|

5bb571ccc0 | ||

|

|

0cacefc749 | ||

|

|

573aa8b5e7 | ||

|

|

c2a8290965 | ||

|

|

772ee52ef2 | ||

|

|

46aee85d2a | ||

|

|

2ae33db83f | ||

|

|

1c00764d01 | ||

|

|

2ba6d74af8 | ||

|

|

dd39e5d944 | ||

|

|

db8c79c463 | ||

|

|

2b6e9d83fa | ||

|

|

4d9292e50a | ||

|

|

4a4450d6b6 | ||

|

|

fe4f4446f1 | ||

|

|

214ed092f2 | ||

|

|

4396350271 | ||

|

|

80be6fa130 | ||

|

|

45945f698a | ||

|

|

08fcc7b31c | ||

|

|

74f317abf8 | ||

|

|

5602e0e5fc | ||

|

|

2d2407410e | ||

|

|

09f575fd4d | ||

|

|

859f8361bb | ||

|

|

c3024be8bf | ||

|

|

7e1aa5f4d6 | ||

|

|

83bfb54f20 | ||

|

|

52ca6c515c | ||

|

|

e9f37c4049 | ||

|

|

c95943b663 | ||

|

|

04af36e7e2 | ||

|

|

d1d7d432e9 | ||

|

|

089a63c573 | ||

|

|

ed19a92bbe | ||

|

|

8abb8645ae | ||

|

|

efe4c98341 | ||

|

|

82707654ad | ||

|

|

57c565c402 | ||

|

|

dd523c94ff | ||

|

|

a28f9ae7a3 | ||

|

|

9993792656 | ||

|

|

f0ae7eea95 | ||

|

|

b22b0a5c75 | ||

|

|

c7a13c89c7 | ||

|

|

39a70f10bd | ||

|

|

a3c0e4cf44 | ||

|

|

9b13444b9c | ||

|

|

0eb01dea55 | ||

|

|

a3aa3b1712 | ||

|

|

95b5aed41b | ||

|

|

d9184ab21c | ||

|

|

e7dd77836d | ||

|

|

4c5c486d28 | ||

|

|

f403ac6132 | ||

|

|

b39cf6e2c0 | ||

|

|

71b728d5fc | ||

|

|

f0ef81f865 | ||

|

|

f68a48b354 | ||

|

|

7a0d2a2d45 | ||

|

|

e13e503cbc | ||

|

|

125039f491 | ||

|

|

f2b300a221 | ||

|

|

9ab964d0b8 | ||

|

|

663aad2b0d | ||

|

|

12d30afb39 | ||

|

|

107fa754e5 | ||

|

|

a17d1180cb | ||

|

|

014fd3d037 | ||

|

|

b29c5a750c | ||

|

|

b612d0b091 | ||

|

|

d94c0d70fe | ||

|

|

045a3dbe48 | ||

|

|

08ae46b163 | ||

|

|

4e5db58a71 | ||

|

|

e45e272e9d | ||

|

|

a9d29ac78c | ||

|

|

5c065eee79 | ||

|

|

048e7cd428 | ||

|

|

a76ad2d1d5 | ||

|

|

9d0f9736bf | ||

|

|

00bb8a65a6 | ||

|

|

dac2bd163a | ||

|

|

78d1fb5ce6 | ||

|

|

14d7b24619 | ||

|

|

3bc0d83769 | ||

|

|

ffdfd5f615 | ||

|

|

d01d953262 | ||

|

|

914d1505df | ||

|

|

8590d5dbca | ||

|

|

496c8cdc09 | ||

|

|

39aa390d2b | ||

|

|

82713e9aa6 | ||

|

|

e067d64b53 | ||

|

|

3d400667d2 | ||

|

|

2aef2872fb | ||

|

|

43c0a69843 | ||

|

|

8aed5125de | ||

|

|

e0f007f2a9 | ||

|

|

3c29784825 | ||

|

|

8f1e930bf4 | ||

|

|

f771396e90 | ||

|

|

f67b3f4452 | ||

|

|

21f5b618c3 | ||

|

|

64bffe5238 | ||

|

|

cebee02698 | ||

|

|

5471b0deb0 | ||

|

|

bc9fc4ccee | ||

|

|

2b1a3080e7 | ||

|

|

92a1af8024 | ||

|

|

b35b053b8d | ||

|

|

55521eece0 | ||

|

|

b32abdd327 | ||

|

|

d1ecfde487 | ||

|

|

04ad46a9a7 | ||

|

|

4c561411aa | ||

|

|

43a41c6c43 | ||

|

|

5367daa210 | ||

|

|

b825e4602c | ||

|

|

188e54b760 | ||

|

|

2c5f5c324a | ||

|

|

5777be5208 | ||

|

|

e727a0d222 | ||

|

|

cdd8882a01 | ||

|

|

3f3502fb57 | ||

|

|

20c00603a8 | ||

|

|

9239fefa52 | ||

|

|

53d60543e5 | ||

|

|

22e3aca89c | ||

|

|

8d86f58174 | ||

|

|

e5cc64a563 | ||

|

|

c7406d6b27 | ||

|

|

d2da3c4236 | ||

|

|

2bad87f2f6 | ||

|

|

ed62e566bb | ||

|

|

51b3dc2c11 | ||

|

|

74f4a8fab9 | ||

|

|

a75baf9143 | ||

|

|

b03721b4d9 | ||

|

|

6b790bace6 | ||

|

|

dcaecfd20b | ||

|

|

553ac4aa1b | ||

|

|

f0c8c95871 | ||

|

|

c2e1d4b71b | ||

|

|

3a72e6f003 | ||

|

|

f7b5abb595 | ||

|

|

b8ad17902f | ||

|

|

9a9ac79edf | ||

|

|

6473aa1dd7 | ||

|

|

b599adc938 | ||

|

|

5e96e1369d | ||

|

|

c0be52a773 | ||

|

|

fb312acb7f | ||

|

|

938bd71844 | ||

|

|

b3020db63f | ||

|

|

e42b2f7aa9 | ||

|

|

f9478f0d47 | ||

|

|

4fc9f1f8c5 | ||

|

|

5a3d1a57b6 | ||

|

|

7db98baa86 | ||

|

|

d591891048 | ||

|

|

3a93d18bb5 | ||

|

|

7511674333 | ||

|

|

883bd1269c | ||

|

|

2aa27b7a4b | ||

|

|

5ea5fefcd2 | ||

|

|

6a79ac6a03 | ||

|

|

ea2dfd09ef | ||

|

|

7380801dfc | ||

|

|

ae33d72479 | ||

|

|

19c2752e87 | ||

|

|

d80af9c17b | ||

|

|

fb230aff1b | ||

|

|

8cbd3f4fca | ||

|

|

b18db9fbbd | ||

|

|

b1635f4bf6 | ||

|

|

44013fe0ef | ||

|

|

9fd7fb813d | ||

|

|

89a9d3a92c | ||

|

|

9682772b09 | ||

|

|

b18a09edb5 | ||

|

|

c086e85d17 | ||

|

|

26efa88908 | ||

|

|

1bec2bfe07 | ||

|

|

76f53429be | ||

|

|

73d612ff9c | ||

|

|

58a809eaff | ||

|

|

93134cdd15 | ||

|

|

b7e7ee387a | ||

|

|

57d8483eaf | ||

|

|

949ee6fcc9 | ||

|

|

26a81d075c | ||

|

|

8c3a52ecc9 | ||

|

|

86f4e20337 | ||

|

|

9abbee0632 | ||

|

|

74eba06d13 | ||

|

|

4e1acc62f9 | ||

|

|

c20745b6e8 | ||

|

|

4cabb37977 | ||

|

|

86eba1d2cf | ||

|

|

05940940c0 | ||

|

|

6bbb4d426e | ||

|

|

7817e95a86 | ||

|

|

443ce7a30b | ||

|

|

ed2e431950 | ||

|

|

0fef7b4684 | ||

|

|

67e698af67 | ||

|

|

7c35aee042 | ||

|

|

481823796e | ||

|

|

835b0d54cd | ||

|

|

505768ea86 | ||

|

|

1614d30d1b | ||

|

|

25566182a8 | ||

|

|

6dffc88b44 | ||

|

|

64d5ceda71 | ||

|

|

e8806f29dc | ||

|

|

2ce9ad235c | ||

|

|

3fb12e41b7 | ||

|

|

591e3c1813 | ||

|

|

b5ba463512 | ||

|

|

e0d7f1d99d | ||

|

|

a68501bede | ||

|

|

c425afb08b | ||

|

|

46029b2707 | ||

|

|

02acae8e1d | ||

|

|

91a50ea637 | ||

|

|

9f644d8dc3 | ||

|

|

36dc97c841 | ||

|

|

e6bad080cb | ||

|

|

7f17237ada | ||

|

|

ebd3ea380c | ||

|

|

bf3a13bb4e | ||

|

|

1a170c4762 | ||

|

|

552cdbd6d8 | ||

|

|

a86514f1ad | ||

|

|

2e8a3d20dd | ||

|

|

66051883fb | ||

|

|

f7fbdc4b2a | ||

|

|

00f1296537 | ||

|

|

ebdb624d29 | ||

|

|

93df55d597 | ||

|

|

56bc806d52 | ||

|

|

25f8ac731f | ||

|

|

4ba1667978 | ||

|

|

0ca064287e | ||

|

|

a3171714ce | ||

|

|

4a1668fe37 | ||

|

|

4eb356f165 | ||

|

|

a7218574f2 | ||

|

|

ddfe94b33b | ||

|

|

8746188ed7 | ||

|

|

1bfcf164f1 | ||

|

|

d3bc5a1413 | ||

|

|

6e279730cf | ||

|

|

5e817e4343 | ||

|

|

b4636d4185 | ||

|

|

22ee0ac467 | ||

|

|

17089b1287 | ||

|

|

7ee808d5d7 | ||

|

|

9ff26af68b | ||

|

|

7dbcef745a | ||

|

|

cae42728ab | ||

|

|

50f65d683d | ||

|

|

0fc1cc8076 | ||

|

|

943eae1211 | ||

|

|

4c928c8d12 | ||

|

|

687044519b | ||

|

|

758323532b | ||

|

|

8bd844cdc1 | ||

|

|

4d4ebf600e | ||

|

|

e6a8c9d269 | ||

|

|

da48f74e7b | ||

|

|

e5d9f483f0 | ||

|

|

303c3410e2 | ||

|

|

de1dde1a06 | ||

|

|

3eb8fb1875 | ||

|

|

fda66db0d8 | ||

|

|

3815b82bef | ||

|

|

37fbefb3cd | ||

|

|

c6e28faa57 | ||

|

|

a888223869 | ||

|

|

d30ea7966d | ||

|

|

df9cb2f11c | ||

|

|

8544e219b0 | ||

|

|

186a2665ad | ||

|

|

f2f2ce0d7d | ||

|

|

c9fda104b4 | ||

|

|

aa40cb9345 | ||

|

|

b8734405c6 | ||

|

|

29c9008e07 | ||

|

|

c1b14fcdd6 | ||

|

|

4735b21318 |

21

.github/workflows/typos.yml

vendored

Normal file

21

.github/workflows/typos.yml

vendored

Normal file

@@ -0,0 +1,21 @@

|

||||

---

|

||||

# yamllint disable rule:line-length

|

||||

name: Typos

|

||||

|

||||

on: # yamllint disable-line rule:truthy

|

||||

push:

|

||||

pull_request:

|

||||

types:

|

||||

- opened

|

||||

- synchronize

|

||||

- reopened

|

||||

|

||||

jobs:

|

||||

build:

|

||||

runs-on: ubuntu-latest

|

||||

|

||||

steps:

|

||||

- uses: actions/checkout@v3

|

||||

|

||||

- name: typos-action

|

||||

uses: crate-ci/typos@v1.13.10

|

||||

3

.gitignore

vendored

3

.gitignore

vendored

@@ -3,4 +3,5 @@ __pycache__

|

||||

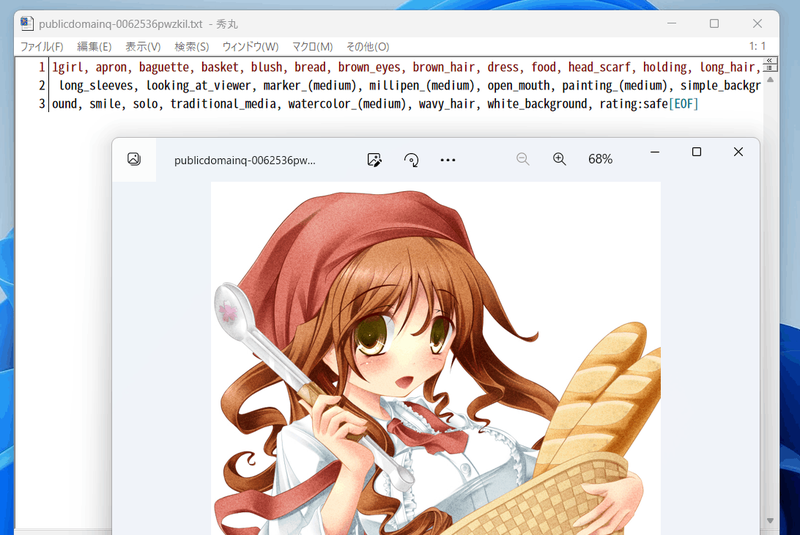

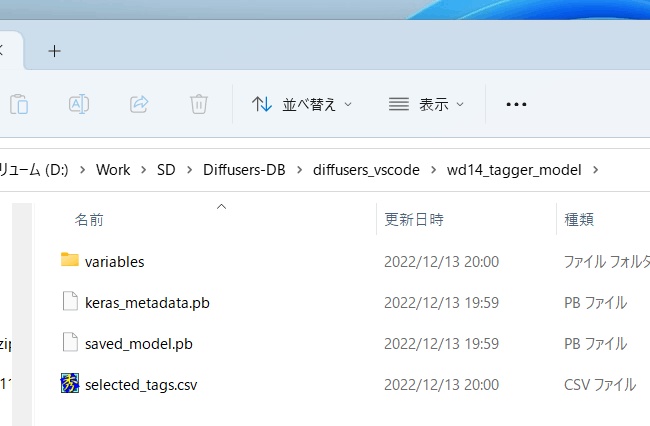

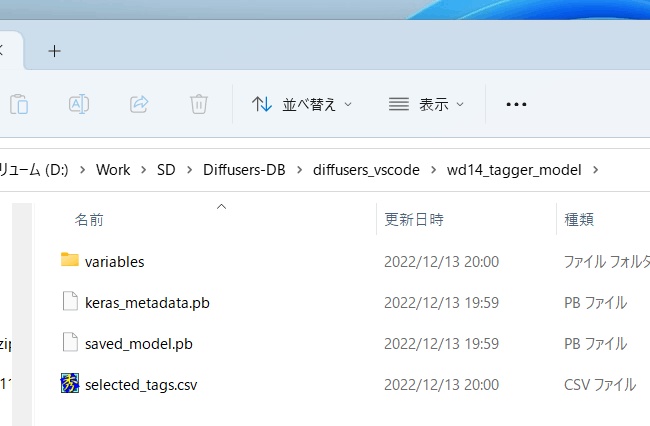

wd14_tagger_model

|

||||

venv

|

||||

*.egg-info

|

||||

build

|

||||

build

|

||||

.vscode

|

||||

32

README-ja.md

32

README-ja.md

@@ -1,7 +1,7 @@

|

||||

## リポジトリについて

|

||||

Stable Diffusionの学習、画像生成、その他のスクリプトを入れたリポジトリです。

|

||||

|

||||

[README in English](./README.md)

|

||||

[README in English](./README.md) ←更新情報はこちらにあります

|

||||

|

||||

GUIやPowerShellスクリプトなど、より使いやすくする機能が[bmaltais氏のリポジトリ](https://github.com/bmaltais/kohya_ss)で提供されています(英語です)のであわせてご覧ください。bmaltais氏に感謝します。

|

||||

|

||||

@@ -16,9 +16,12 @@ GUIやPowerShellスクリプトなど、より使いやすくする機能が[bma

|

||||

|

||||

当リポジトリ内およびnote.comに記事がありますのでそちらをご覧ください(将来的にはすべてこちらへ移すかもしれません)。

|

||||

|

||||

* note.com [環境整備とDreamBooth学習スクリプトについて](https://note.com/kohya_ss/n/nba4eceaa4594)

|

||||

* [学習について、共通編](./train_README-ja.md) : データ整備やオプションなど

|

||||

* [データセット設定](./config_README-ja.md)

|

||||

* [DreamBoothの学習について](./train_db_README-ja.md)

|

||||

* [fine-tuningのガイド](./fine_tune_README_ja.md):

|

||||

BLIPによるキャプショニングと、DeepDanbooruまたはWD14 taggerによるタグ付けを含みます

|

||||

* [LoRAの学習について](./train_network_README-ja.md)

|

||||

* [Textual Inversionの学習について](./train_ti_README-ja.md)

|

||||

* note.com [画像生成スクリプト](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* note.com [モデル変換スクリプト](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

|

||||

@@ -44,12 +47,11 @@ PowerShellを使う場合、venvを使えるようにするためには以下の

|

||||

|

||||

通常の(管理者ではない)PowerShellを開き以下を順に実行します。

|

||||

|

||||

|

||||

```powershell

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

python -m venv venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

@@ -63,6 +65,12 @@ cp .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cuda_set

|

||||

accelerate config

|

||||

```

|

||||

|

||||

<!--

|

||||

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 --extra-index-url https://download.pytorch.org/whl/cu117

|

||||

pip install --use-pep517 --upgrade -r requirements.txt

|

||||

pip install -U -I --no-deps xformers==0.0.16

|

||||

-->

|

||||

|

||||

コマンドプロンプトでは以下になります。

|

||||

|

||||

|

||||

@@ -70,7 +78,7 @@ accelerate config

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

python -m venv venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

@@ -84,6 +92,8 @@ copy /y .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cud

|

||||

accelerate config

|

||||

```

|

||||

|

||||

(注:``python -m venv venv`` のほうが ``python -m venv --system-site-packages venv`` より安全そうなため書き換えました。globalなpythonにパッケージがインストールしてあると、後者だといろいろと問題が起きます。)

|

||||

|

||||

accelerate configの質問には以下のように答えてください。(bf16で学習する場合、最後の質問にはbf16と答えてください。)

|

||||

|

||||

※0.15.0から日本語環境では選択のためにカーソルキーを押すと落ちます(……)。数字キーの0、1、2……で選択できますので、そちらを使ってください。

|

||||

@@ -99,7 +109,11 @@ accelerate configの質問には以下のように答えてください。(bf1

|

||||

```

|

||||

|

||||

※場合によって ``ValueError: fp16 mixed precision requires a GPU`` というエラーが出ることがあるようです。この場合、6番目の質問(

|

||||

``What GPU(s) (by id) should be used for training on this machine as a comma-seperated list? [all]:``)に「0」と答えてください。(id `0`のGPUが使われます。)

|

||||

``What GPU(s) (by id) should be used for training on this machine as a comma-separated list? [all]:``)に「0」と答えてください。(id `0`のGPUが使われます。)

|

||||

|

||||

### PyTorchとxformersのバージョンについて

|

||||

|

||||

他のバージョンでは学習がうまくいかない場合があるようです。特に他の理由がなければ指定のバージョンをお使いください。

|

||||

|

||||

## アップグレード

|

||||

|

||||

@@ -109,7 +123,7 @@ accelerate configの質問には以下のように答えてください。(bf1

|

||||

cd sd-scripts

|

||||

git pull

|

||||

.\venv\Scripts\activate

|

||||

pip install --upgrade -r <requirement file name>

|

||||

pip install --use-pep517 --upgrade -r requirements.txt

|

||||

```

|

||||

|

||||

コマンドが成功すれば新しいバージョンが使用できます。

|

||||

@@ -118,6 +132,8 @@ pip install --upgrade -r <requirement file name>

|

||||

|

||||

LoRAの実装は[cloneofsimo氏のリポジトリ](https://github.com/cloneofsimo/lora)を基にしたものです。感謝申し上げます。

|

||||

|

||||

Conv2d 3x3への拡大は [cloneofsimo氏](https://github.com/cloneofsimo/lora) が最初にリリースし、KohakuBlueleaf氏が [LoCon](https://github.com/KohakuBlueleaf/LoCon) でその有効性を明らかにしたものです。KohakuBlueleaf氏に深く感謝します。

|

||||

|

||||

## ライセンス

|

||||

|

||||

スクリプトのライセンスはASL 2.0ですが(Diffusersおよびcloneofsimo氏のリポジトリ由来のものも同様)、一部他のライセンスのコードを含みます。

|

||||

|

||||

174

README.md

174

README.md

@@ -1,33 +1,22 @@

|

||||

This repository contains training, generation and utility scripts for Stable Diffusion.

|

||||

|

||||

## Updates

|

||||

|

||||

- January 14, 2023, 2023/1/14

|

||||

- Fix loading some VAE or .safetensors as VAE is failed for ``--vae`` option. Thanks to Fannovel16!

|

||||

- Add negative prompt scaling for ``gen_img_diffusers.py`` You can set another conditioning scale to the negative prompt with ``--negative_scale`` option, and ``--nl`` option for the prompt. Thanks to laksjdjf!

|

||||

- ``--vae`` オプションに一部のVAEや .safetensors 形式のモデルを指定するとエラーになる不具合を修正しました。Fannovel16氏に感謝します。

|

||||

- ``gen_img_diffusers.py`` に、ネガティブプロンプトに異なる guidance scale を設定できる ``--negative_scale`` オプションを追加しました。プロンプトからは ``--nl`` で指定できます。laksjdjf氏に感謝します。

|

||||

- January 12, 2023, 2023/1/12

|

||||

- Metadata is saved on the model (.safetensors only) (model name, VAE name, training steps, learning rate etc.) The metadata will be able to inspect by sd-webui-additional-networks extension in near future. If you do not want to save it, specify ``no_metadata`` option.

|

||||

- メタデータが保存されるようになりました( .safetensors 形式の場合のみ)(モデル名、VAE 名、ステップ数、学習率など)。近日中に拡張から確認できるようになる予定です。メタデータを保存したくない場合は ``no_metadata`` オプションをしてしてください。

|

||||

|

||||

**January 9, 2023: Important information about the update can be found at [the end of the page](#updates-jan-9-2023).**

|

||||

|

||||

**20231/1/9: 更新情報が[ページ末尾](#更新情報-202319)にありますのでご覧ください。**

|

||||

[__Change History__](#change-history) is moved to the bottom of the page.

|

||||

更新履歴は[ページ末尾](#change-history)に移しました。

|

||||

|

||||

[日本語版README](./README-ja.md)

|

||||

|

||||

##

|

||||

|

||||

For easier use (GUI and PowerShell scripts etc...), please visit [the repository maintained by bmaltais](https://github.com/bmaltais/kohya_ss). Thanks to @bmaltais!

|

||||

|

||||

This repository contains the scripts for:

|

||||

|

||||

* DreamBooth training, including U-Net and Text Encoder

|

||||

* fine-tuning (native training), including U-Net and Text Encoder

|

||||

* Fine-tuning (native training), including U-Net and Text Encoder

|

||||

* LoRA training

|

||||

* image generation

|

||||

* model conversion (supports 1.x and 2.x, Stable Diffision ckpt/safetensors and Diffusers)

|

||||

* Texutl Inversion training

|

||||

* Image generation

|

||||

* Model conversion (supports 1.x and 2.x, Stable Diffision ckpt/safetensors and Diffusers)

|

||||

|

||||

__Stable Diffusion web UI now seems to support LoRA trained by ``sd-scripts``.__ (SD 1.x based only) Thank you for great work!!!

|

||||

|

||||

## About requirements.txt

|

||||

|

||||

@@ -37,12 +26,14 @@ The scripts are tested with PyTorch 1.12.1 and 1.13.0, Diffusers 0.10.2.

|

||||

|

||||

## Links to how-to-use documents

|

||||

|

||||

All documents are in Japanese currently, and CUI based.

|

||||

All documents are in Japanese currently.

|

||||

|

||||

* [Training guide - common](./train_README-ja.md) : data preparation, options etc...

|

||||

* [Dataset config](./config_README-ja.md)

|

||||

* [DreamBooth training guide](./train_db_README-ja.md)

|

||||

* [Step by Step fine-tuning guide](./fine_tune_README_ja.md):

|

||||

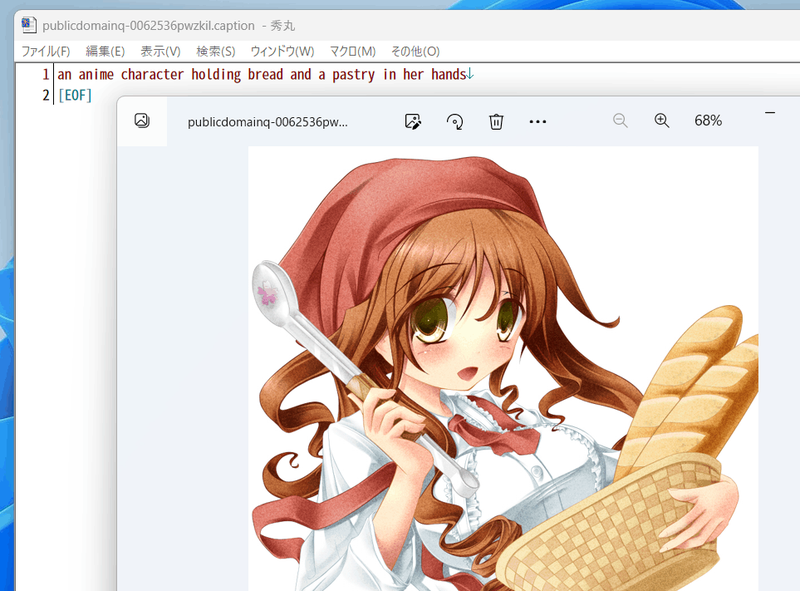

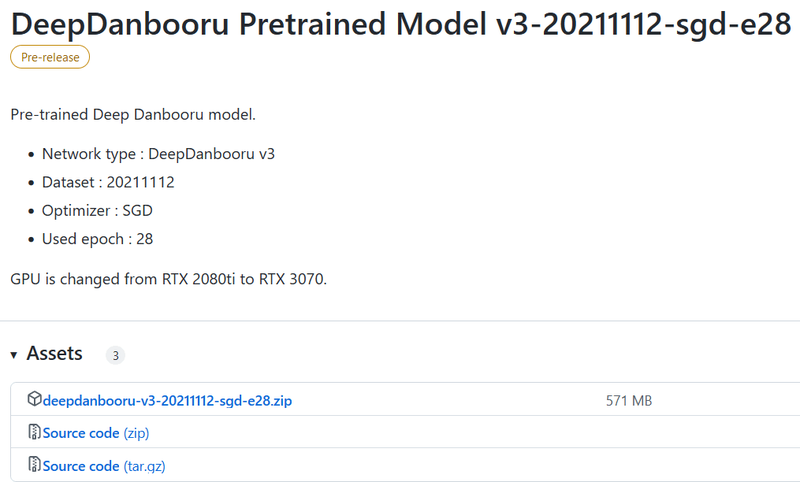

Including BLIP captioning and tagging by DeepDanbooru or WD14 tagger

|

||||

* [training LoRA](./train_network_README-ja.md)

|

||||

* [training Textual Inversion](./train_ti_README-ja.md)

|

||||

* note.com [Image generation](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* note.com [Model conversion](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

|

||||

@@ -67,7 +58,7 @@ Open a regular Powershell terminal and type the following inside:

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

python -m venv venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

@@ -79,9 +70,10 @@ cp .\bitsandbytes_windows\cextension.py .\venv\Lib\site-packages\bitsandbytes\ce

|

||||

cp .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cuda_setup\main.py

|

||||

|

||||

accelerate config

|

||||

|

||||

```

|

||||

|

||||

update: ``python -m venv venv`` is seemed to be safer than ``python -m venv --system-site-packages venv`` (some user have packages in global python).

|

||||

|

||||

Answers to accelerate config:

|

||||

|

||||

```txt

|

||||

@@ -94,11 +86,16 @@ Answers to accelerate config:

|

||||

- fp16

|

||||

```

|

||||

|

||||

note: Some user reports ``ValueError: fp16 mixed precision requires a GPU`` is occured in training. In this case, answer `0` for the 6th question:

|

||||

``What GPU(s) (by id) should be used for training on this machine as a comma-seperated list? [all]:``

|

||||

note: Some user reports ``ValueError: fp16 mixed precision requires a GPU`` is occurred in training. In this case, answer `0` for the 6th question:

|

||||

``What GPU(s) (by id) should be used for training on this machine as a comma-separated list? [all]:``

|

||||

|

||||

(Single GPU with id `0` will be used.)

|

||||

|

||||

### about PyTorch and xformers

|

||||

|

||||

Other versions of PyTorch and xformers seem to have problems with training.

|

||||

If there is no other reason, please install the specified version.

|

||||

|

||||

## Upgrade

|

||||

|

||||

When a new release comes out you can upgrade your repo with the following command:

|

||||

@@ -107,18 +104,20 @@ When a new release comes out you can upgrade your repo with the following comman

|

||||

cd sd-scripts

|

||||

git pull

|

||||

.\venv\Scripts\activate

|

||||

pip install --upgrade -r requirements.txt

|

||||

pip install --use-pep517 --upgrade -r requirements.txt

|

||||

```

|

||||

|

||||

Once the commands have completed successfully you should be ready to use the new version.

|

||||

|

||||

## Credits

|

||||

|

||||

The implementation for LoRA is based on [cloneofsimo's repo](https://github.com/cloneofsimo/lora). Thank you for great work!!!

|

||||

The implementation for LoRA is based on [cloneofsimo's repo](https://github.com/cloneofsimo/lora). Thank you for great work!

|

||||

|

||||

The LoRA expansion to Conv2d 3x3 was initially released by cloneofsimo and its effectiveness was demonstrated at [LoCon](https://github.com/KohakuBlueleaf/LoCon) by KohakuBlueleaf. Thank you so much KohakuBlueleaf!

|

||||

|

||||

## License

|

||||

|

||||

The majority of scripts is licensed under ASL 2.0 (including codes from Diffusers, cloneofsimo's), however portions of the project are available under separate license terms:

|

||||

The majority of scripts is licensed under ASL 2.0 (including codes from Diffusers, cloneofsimo's and LoCon), however portions of the project are available under separate license terms:

|

||||

|

||||

[Memory Efficient Attention Pytorch](https://github.com/lucidrains/memory-efficient-attention-pytorch): MIT

|

||||

|

||||

@@ -126,78 +125,77 @@ The majority of scripts is licensed under ASL 2.0 (including codes from Diffuser

|

||||

|

||||

[BLIP](https://github.com/salesforce/BLIP): BSD-3-Clause

|

||||

|

||||

## Change History

|

||||

|

||||

# Updates: Jan 9. 2023

|

||||

- 1 Apr. 2023, 2023/4/1:

|

||||

- Fix an issue that `merge_lora.py` does not work with the latest version.

|

||||

- Fix an issue that `merge_lora.py` does not merge Conv2d3x3 weights.

|

||||

- 最新のバージョンで`merge_lora.py` が動作しない不具合を修正しました。

|

||||

- `merge_lora.py` で `no module found for LoRA weight: ...` と表示され Conv2d3x3 拡張の重みがマージされない不具合を修正しました。

|

||||

- 31 Mar. 2023, 2023/3/31:

|

||||

- Fix an issue that the VRAM usage temporarily increases when loading a model in `train_network.py`.

|

||||

- Fix an issue that an error occurs when loading a `.safetensors` model in `train_network.py`. [#354](https://github.com/kohya-ss/sd-scripts/issues/354)

|

||||

- `train_network.py` でモデル読み込み時にVRAM使用量が一時的に大きくなる不具合を修正しました。

|

||||

- `train_network.py` で `.safetensors` 形式のモデルを読み込むとエラーになる不具合を修正しました。[#354](https://github.com/kohya-ss/sd-scripts/issues/354)

|

||||

- 30 Mar. 2023, 2023/3/30:

|

||||

- Support [P+](https://prompt-plus.github.io/) training. Thank you jakaline-dev!

|

||||

- See [#327](https://github.com/kohya-ss/sd-scripts/pull/327) for details.

|

||||

- Use `train_textual_inversion_XTI.py` for training. The usage is almost the same as `train_textual_inversion.py`. However, sample image generation during training is not supported.

|

||||

- Use `gen_img_diffusers.py` for image generation (I think Web UI is not supported). Specify the embedding with `--XTI_embeddings` option.

|

||||

- Reduce RAM usage at startup in `train_network.py`. [#332](https://github.com/kohya-ss/sd-scripts/pull/332) Thank you guaneec!

|

||||

- Support pre-merge for LoRA in `gen_img_diffusers.py`. Specify `--network_merge` option. Note that the `--am` option of the prompt option is no longer available with this option.

|

||||

|

||||

All training scripts are updated.

|

||||

- [P+](https://prompt-plus.github.io/) の学習に対応しました。jakaline-dev氏に感謝します。

|

||||

- 詳細は [#327](https://github.com/kohya-ss/sd-scripts/pull/327) をご参照ください。

|

||||

- 学習には `train_textual_inversion_XTI.py` を使用します。使用法は `train_textual_inversion.py` とほぼ同じです。た

|

||||

だし学習中のサンプル生成には対応していません。

|

||||

- 画像生成には `gen_img_diffusers.py` を使用してください(Web UIは対応していないと思われます)。`--XTI_embeddings` オプションで学習したembeddingを指定してください。

|

||||

- `train_network.py` で起動時のRAM使用量を削減しました。[#332](https://github.com/kohya-ss/sd-scripts/pull/332) guaneec氏に感謝します。

|

||||

- `gen_img_diffusers.py` でLoRAの事前マージに対応しました。`--network_merge` オプションを指定してください。なおプロンプトオプションの `--am` は使用できなくなります。

|

||||

|

||||

## Breaking Changes

|

||||

## Sample image generation during training

|

||||

A prompt file might look like this, for example

|

||||

|

||||

- The ``fine_tuning`` option in ``train_db.py`` is removed. Please use DreamBooth with captions or ``fine_tune.py``.

|

||||

- The Hypernet feature in ``fine_tune.py`` is removed, will be implemented in ``train_network.py`` in future.

|

||||

```

|

||||

# prompt 1

|

||||

masterpiece, best quality, (1girl), in white shirts, upper body, looking at viewer, simple background --n low quality, worst quality, bad anatomy,bad composition, poor, low effort --w 768 --h 768 --d 1 --l 7.5 --s 28

|

||||

|

||||

## Features, Improvements and Bug Fixes

|

||||

# prompt 2

|

||||

masterpiece, best quality, 1boy, in business suit, standing at street, looking back --n (low quality, worst quality), bad anatomy,bad composition, poor, low effort --w 576 --h 832 --d 2 --l 5.5 --s 40

|

||||

```

|

||||

|

||||

### for all script: train_db.py, fine_tune.py and train_network.py

|

||||

Lines beginning with `#` are comments. You can specify options for the generated image with options like `--n` after the prompt. The following can be used.

|

||||

|

||||

- Added ``output_name`` option. The name of output file can be specified.

|

||||

- With ``--output_name style1``, the output file is like ``style1_000001.ckpt`` (or ``.safetensors``) for each epoch and ``style1.ckpt`` for last.

|

||||

- If ommitted (default), same to previous. ``epoch-000001.ckpt`` and ``last.ckpt``.

|

||||

- Added ``save_last_n_epochs`` option. Keep only latest n files for the checkpoints and the states. Older files are removed. (Thanks to shirayu!)

|

||||

- If the options are ``--save_every_n_epochs=2 --save_last_n_epochs=3``, in the end of epoch 8, ``epoch-000008.ckpt`` is created and ``epoch-000002.ckpt`` is removed.

|

||||

* `--n` Negative prompt up to the next option.

|

||||

* `--w` Specifies the width of the generated image.

|

||||

* `--h` Specifies the height of the generated image.

|

||||

* `--d` Specifies the seed of the generated image.

|

||||

* `--l` Specifies the CFG scale of the generated image.

|

||||

* `--s` Specifies the number of steps in the generation.

|

||||

|

||||

### train_db.py

|

||||

The prompt weighting such as `( )` and `[ ]` are working.

|

||||

|

||||

- Added ``max_token_length`` option. Captions can have more than 75 tokens.

|

||||

## サンプル画像生成

|

||||

プロンプトファイルは例えば以下のようになります。

|

||||

|

||||

### fine_tune.py

|

||||

```

|

||||

# prompt 1

|

||||

masterpiece, best quality, (1girl), in white shirts, upper body, looking at viewer, simple background --n low quality, worst quality, bad anatomy,bad composition, poor, low effort --w 768 --h 768 --d 1 --l 7.5 --s 28

|

||||

|

||||

- The script now works without .npz files. If .npz is not found, the scripts get the latents with VAE.

|

||||

- You can omit ``prepare_buckets_latents.py`` in preprocessing. However, it is recommended if you train more than 1 or 2 epochs.

|

||||

- ``--resolution`` option is required to specify the training resolution.

|

||||

- Added ``cache_latents`` and ``color_aug`` options.

|

||||

# prompt 2

|

||||

masterpiece, best quality, 1boy, in business suit, standing at street, looking back --n (low quality, worst quality), bad anatomy,bad composition, poor, low effort --w 576 --h 832 --d 2 --l 5.5 --s 40

|

||||

```

|

||||

|

||||

### train_network.py

|

||||

`#` で始まる行はコメントになります。`--n` のように「ハイフン二個+英小文字」の形でオプションを指定できます。以下が使用可能できます。

|

||||

|

||||

- Now ``--gradient_checkpointing`` is effective for U-Net and Text Encoder.

|

||||

- The memory usage is reduced. The larger batch size is avilable, but the training speed will be slow.

|

||||

- The training might be possible with 6GB VRAM for dimension=4 with batch size=1.

|

||||

* `--n` Negative prompt up to the next option.

|

||||

* `--w` Specifies the width of the generated image.

|

||||

* `--h` Specifies the height of the generated image.

|

||||

* `--d` Specifies the seed of the generated image.

|

||||

* `--l` Specifies the CFG scale of the generated image.

|

||||

* `--s` Specifies the number of steps in the generation.

|

||||

|

||||

Documents are not updated now, I will update one by one.

|

||||

`( )` や `[ ]` などの重みづけも動作します。

|

||||

|

||||

# 更新情報 (2023/1/9)

|

||||

|

||||

学習スクリプトを更新しました。

|

||||

|

||||

## 削除された機能

|

||||

- ``train_db.py`` の ``fine_tuning`` は削除されました。キャプション付きの DreamBooth または ``fine_tune.py`` を使ってください。

|

||||

- ``fine_tune.py`` の Hypernet学習の機能は削除されました。将来的に``train_network.py``に追加される予定です。

|

||||

|

||||

## その他の機能追加、バグ修正など

|

||||

|

||||

### 学習スクリプトに共通: train_db.py, fine_tune.py and train_network.py

|

||||

|

||||

- ``output_name``オプションを追加しました。保存されるモデルファイルの名前を指定できます。

|

||||

- ``--output_name style1``と指定すると、エポックごとに保存されるファイル名は``style1_000001.ckpt`` (または ``.safetensors``) に、最後に保存されるファイル名は``style1.ckpt``になります。

|

||||

- 省略時は今までと同じです(``epoch-000001.ckpt``および``last.ckpt``)。

|

||||

- ``save_last_n_epochs``オプションを追加しました。最新の n ファイル、stateだけ保存し、古いものは削除します。(shirayu氏に感謝します。)

|

||||

- たとえば``--save_every_n_epochs=2 --save_last_n_epochs=3``と指定した時、8エポック目の終了時には、``epoch-000008.ckpt``が保存され``epoch-000002.ckpt``が削除されます。

|

||||

|

||||

### train_db.py

|

||||

|

||||

- ``max_token_length``オプションを追加しました。75文字を超えるキャプションが使えるようになります。

|

||||

|

||||

### fine_tune.py

|

||||

|

||||

- .npzファイルがなくても動作するようになりました。.npzファイルがない場合、VAEからlatentsを取得して動作します。

|

||||

- ``prepare_buckets_latents.py``を前処理で実行しなくても良くなります。ただし事前取得をしておいたほうが、2エポック以上学習する場合にはトータルで高速です。

|

||||

- この場合、解像度を指定するために``--resolution``オプションが必要です。

|

||||

- ``cache_latents``と``color_aug``オプションを追加しました。

|

||||

|

||||

### train_network.py

|

||||

|

||||

- ``--gradient_checkpointing``がU-NetとText Encoderにも有効になりました。

|

||||

- メモリ消費が減ります。バッチサイズを大きくできますが、トータルでの学習時間は長くなるかもしれません。

|

||||

- dimension=4のLoRAはバッチサイズ1で6GB VRAMで学習できるかもしれません。

|

||||

|

||||

ドキュメントは未更新ですが少しずつ更新の予定です。

|

||||

Please read [Releases](https://github.com/kohya-ss/sd-scripts/releases) for recent updates.

|

||||

最近の更新情報は [Release](https://github.com/kohya-ss/sd-scripts/releases) をご覧ください。

|

||||

|

||||

209

XTI_hijack.py

Normal file

209

XTI_hijack.py

Normal file

@@ -0,0 +1,209 @@

|

||||

import torch

|

||||

from typing import Union, List, Optional, Dict, Any, Tuple

|

||||

from diffusers.models.unet_2d_condition import UNet2DConditionOutput

|

||||

|

||||

def unet_forward_XTI(self,

|

||||

sample: torch.FloatTensor,

|

||||

timestep: Union[torch.Tensor, float, int],

|

||||

encoder_hidden_states: torch.Tensor,

|

||||

class_labels: Optional[torch.Tensor] = None,

|

||||

return_dict: bool = True,

|

||||

) -> Union[UNet2DConditionOutput, Tuple]:

|

||||

r"""

|

||||

Args:

|

||||

sample (`torch.FloatTensor`): (batch, channel, height, width) noisy inputs tensor

|

||||

timestep (`torch.FloatTensor` or `float` or `int`): (batch) timesteps

|

||||

encoder_hidden_states (`torch.FloatTensor`): (batch, sequence_length, feature_dim) encoder hidden states

|

||||

return_dict (`bool`, *optional*, defaults to `True`):

|

||||

Whether or not to return a [`models.unet_2d_condition.UNet2DConditionOutput`] instead of a plain tuple.

|

||||

|

||||

Returns:

|

||||

[`~models.unet_2d_condition.UNet2DConditionOutput`] or `tuple`:

|

||||

[`~models.unet_2d_condition.UNet2DConditionOutput`] if `return_dict` is True, otherwise a `tuple`. When

|

||||

returning a tuple, the first element is the sample tensor.

|

||||

"""

|

||||

# By default samples have to be AT least a multiple of the overall upsampling factor.

|

||||

# The overall upsampling factor is equal to 2 ** (# num of upsampling layears).

|

||||

# However, the upsampling interpolation output size can be forced to fit any upsampling size

|

||||

# on the fly if necessary.

|

||||

default_overall_up_factor = 2**self.num_upsamplers

|

||||

|

||||

# upsample size should be forwarded when sample is not a multiple of `default_overall_up_factor`

|

||||

forward_upsample_size = False

|

||||

upsample_size = None

|

||||

|

||||

if any(s % default_overall_up_factor != 0 for s in sample.shape[-2:]):

|

||||

logger.info("Forward upsample size to force interpolation output size.")

|

||||

forward_upsample_size = True

|

||||

|

||||

# 0. center input if necessary

|

||||

if self.config.center_input_sample:

|

||||

sample = 2 * sample - 1.0

|

||||

|

||||

# 1. time

|

||||

timesteps = timestep

|

||||

if not torch.is_tensor(timesteps):

|

||||

# TODO: this requires sync between CPU and GPU. So try to pass timesteps as tensors if you can

|

||||

# This would be a good case for the `match` statement (Python 3.10+)

|

||||

is_mps = sample.device.type == "mps"

|

||||

if isinstance(timestep, float):

|

||||

dtype = torch.float32 if is_mps else torch.float64

|

||||

else:

|

||||

dtype = torch.int32 if is_mps else torch.int64

|

||||

timesteps = torch.tensor([timesteps], dtype=dtype, device=sample.device)

|

||||

elif len(timesteps.shape) == 0:

|

||||

timesteps = timesteps[None].to(sample.device)

|

||||

|

||||

# broadcast to batch dimension in a way that's compatible with ONNX/Core ML

|

||||

timesteps = timesteps.expand(sample.shape[0])

|

||||

|

||||

t_emb = self.time_proj(timesteps)

|

||||

|

||||

# timesteps does not contain any weights and will always return f32 tensors

|

||||

# but time_embedding might actually be running in fp16. so we need to cast here.

|

||||

# there might be better ways to encapsulate this.

|

||||

t_emb = t_emb.to(dtype=self.dtype)

|

||||

emb = self.time_embedding(t_emb)

|

||||

|

||||

if self.config.num_class_embeds is not None:

|

||||

if class_labels is None:

|

||||

raise ValueError("class_labels should be provided when num_class_embeds > 0")

|

||||

class_emb = self.class_embedding(class_labels).to(dtype=self.dtype)

|

||||

emb = emb + class_emb

|

||||

|

||||

# 2. pre-process

|

||||

sample = self.conv_in(sample)

|

||||

|

||||

# 3. down

|

||||

down_block_res_samples = (sample,)

|

||||

down_i = 0

|

||||

for downsample_block in self.down_blocks:

|

||||

if hasattr(downsample_block, "has_cross_attention") and downsample_block.has_cross_attention:

|

||||

sample, res_samples = downsample_block(

|

||||

hidden_states=sample,

|

||||

temb=emb,

|

||||

encoder_hidden_states=encoder_hidden_states[down_i:down_i+2],

|

||||

)

|

||||

down_i += 2

|

||||

else:

|

||||

sample, res_samples = downsample_block(hidden_states=sample, temb=emb)

|

||||

|

||||

down_block_res_samples += res_samples

|

||||

|

||||

# 4. mid

|

||||

sample = self.mid_block(sample, emb, encoder_hidden_states=encoder_hidden_states[6])

|

||||

|

||||

# 5. up

|

||||

up_i = 7

|

||||

for i, upsample_block in enumerate(self.up_blocks):

|

||||

is_final_block = i == len(self.up_blocks) - 1

|

||||

|

||||

res_samples = down_block_res_samples[-len(upsample_block.resnets) :]

|

||||

down_block_res_samples = down_block_res_samples[: -len(upsample_block.resnets)]

|

||||

|

||||

# if we have not reached the final block and need to forward the

|

||||

# upsample size, we do it here

|

||||

if not is_final_block and forward_upsample_size:

|

||||

upsample_size = down_block_res_samples[-1].shape[2:]

|

||||

|

||||

if hasattr(upsample_block, "has_cross_attention") and upsample_block.has_cross_attention:

|

||||

sample = upsample_block(

|

||||

hidden_states=sample,

|

||||

temb=emb,

|

||||

res_hidden_states_tuple=res_samples,

|

||||

encoder_hidden_states=encoder_hidden_states[up_i:up_i+3],

|

||||

upsample_size=upsample_size,

|

||||

)

|

||||

up_i += 3

|

||||

else:

|

||||

sample = upsample_block(

|

||||

hidden_states=sample, temb=emb, res_hidden_states_tuple=res_samples, upsample_size=upsample_size

|

||||

)

|

||||

# 6. post-process

|

||||

sample = self.conv_norm_out(sample)

|

||||

sample = self.conv_act(sample)

|

||||

sample = self.conv_out(sample)

|

||||

|

||||

if not return_dict:

|

||||

return (sample,)

|

||||

|

||||

return UNet2DConditionOutput(sample=sample)

|

||||

|

||||

def downblock_forward_XTI(

|

||||

self, hidden_states, temb=None, encoder_hidden_states=None, attention_mask=None, cross_attention_kwargs=None

|

||||

):

|

||||

output_states = ()

|

||||

i = 0

|

||||

|

||||

for resnet, attn in zip(self.resnets, self.attentions):

|

||||

if self.training and self.gradient_checkpointing:

|

||||

|

||||

def create_custom_forward(module, return_dict=None):

|

||||

def custom_forward(*inputs):

|

||||

if return_dict is not None:

|

||||

return module(*inputs, return_dict=return_dict)

|

||||

else:

|

||||

return module(*inputs)

|

||||

|

||||

return custom_forward

|

||||

|

||||

hidden_states = torch.utils.checkpoint.checkpoint(create_custom_forward(resnet), hidden_states, temb)

|

||||

hidden_states = torch.utils.checkpoint.checkpoint(

|

||||

create_custom_forward(attn, return_dict=False), hidden_states, encoder_hidden_states[i]

|

||||

)[0]

|

||||

else:

|

||||

hidden_states = resnet(hidden_states, temb)

|

||||

hidden_states = attn(hidden_states, encoder_hidden_states=encoder_hidden_states[i]).sample

|

||||

|

||||

output_states += (hidden_states,)

|

||||

i += 1

|

||||

|

||||

if self.downsamplers is not None:

|

||||

for downsampler in self.downsamplers:

|

||||

hidden_states = downsampler(hidden_states)

|

||||

|

||||

output_states += (hidden_states,)

|

||||

|

||||

return hidden_states, output_states

|

||||

|

||||

def upblock_forward_XTI(

|

||||

self,

|

||||

hidden_states,

|

||||

res_hidden_states_tuple,

|

||||

temb=None,

|

||||

encoder_hidden_states=None,

|

||||

upsample_size=None,

|

||||

):

|

||||

i = 0

|

||||

for resnet, attn in zip(self.resnets, self.attentions):

|

||||

# pop res hidden states

|

||||

res_hidden_states = res_hidden_states_tuple[-1]

|

||||

res_hidden_states_tuple = res_hidden_states_tuple[:-1]

|

||||

hidden_states = torch.cat([hidden_states, res_hidden_states], dim=1)

|

||||

|

||||

if self.training and self.gradient_checkpointing:

|

||||

|

||||

def create_custom_forward(module, return_dict=None):

|

||||

def custom_forward(*inputs):

|

||||

if return_dict is not None:

|

||||

return module(*inputs, return_dict=return_dict)

|

||||

else:

|

||||

return module(*inputs)

|

||||

|

||||

return custom_forward

|

||||

|

||||

hidden_states = torch.utils.checkpoint.checkpoint(create_custom_forward(resnet), hidden_states, temb)

|

||||

hidden_states = torch.utils.checkpoint.checkpoint(

|

||||

create_custom_forward(attn, return_dict=False), hidden_states, encoder_hidden_states[i]

|

||||

)[0]

|

||||

else:

|

||||

hidden_states = resnet(hidden_states, temb)

|

||||

hidden_states = attn(hidden_states, encoder_hidden_states=encoder_hidden_states[i]).sample

|

||||

|

||||

i += 1

|

||||

|

||||

if self.upsamplers is not None:

|

||||

for upsampler in self.upsamplers:

|

||||

hidden_states = upsampler(hidden_states, upsample_size)

|

||||

|

||||

return hidden_states

|

||||

15

_typos.toml

Normal file

15

_typos.toml

Normal file

@@ -0,0 +1,15 @@

|

||||

# Files for typos

|

||||

# Instruction: https://github.com/marketplace/actions/typos-action#getting-started

|

||||

|

||||

[default.extend-identifiers]

|

||||

|

||||

[default.extend-words]

|

||||

NIN="NIN"

|

||||

parms="parms"

|

||||

nin="nin"

|

||||

extention="extention" # Intentionally left

|

||||

nd="nd"

|

||||

|

||||

|

||||

[files]

|

||||

extend-exclude = ["_typos.toml"]

|

||||

279

config_README-ja.md

Normal file

279

config_README-ja.md

Normal file

@@ -0,0 +1,279 @@

|

||||

For non-Japanese speakers: this README is provided only in Japanese in the current state. Sorry for inconvenience. We will provide English version in the near future.

|

||||

|

||||

`--dataset_config` で渡すことができる設定ファイルに関する説明です。

|

||||

|

||||

## 概要

|

||||

|

||||

設定ファイルを渡すことにより、ユーザが細かい設定を行えるようにします。

|

||||

|

||||

* 複数のデータセットが設定可能になります

|

||||

* 例えば `resolution` をデータセットごとに設定して、それらを混合して学習できます。

|

||||

* DreamBooth の手法と fine tuning の手法の両方に対応している学習方法では、DreamBooth 方式と fine tuning 方式のデータセットを混合することが可能です。

|

||||

* サブセットごとに設定を変更することが可能になります

|

||||

* データセットを画像ディレクトリ別またはメタデータ別に分割したものがサブセットです。いくつかのサブセットが集まってデータセットを構成します。

|

||||

* `keep_tokens` や `flip_aug` 等のオプションはサブセットごとに設定可能です。一方、`resolution` や `batch_size` といったオプションはデータセットごとに設定可能で、同じデータセットに属するサブセットでは値が共通になります。詳しくは後述します。

|

||||

|

||||

設定ファイルの形式は JSON か TOML を利用できます。記述のしやすさを考えると [TOML](https://toml.io/ja/v1.0.0-rc.2) を利用するのがオススメです。以下、TOML の利用を前提に説明します。

|

||||

|

||||

TOML で記述した設定ファイルの例です。

|

||||

|

||||

```toml

|

||||

[general]

|

||||

shuffle_caption = true

|

||||

caption_extension = '.txt'

|

||||

keep_tokens = 1

|

||||

|

||||

# これは DreamBooth 方式のデータセット

|

||||

[[datasets]]

|

||||

resolution = 512

|

||||

batch_size = 4

|

||||

keep_tokens = 2

|

||||

|

||||

[[datasets.subsets]]

|

||||

image_dir = 'C:\hoge'

|

||||

class_tokens = 'hoge girl'

|

||||

# このサブセットは keep_tokens = 2 (所属する datasets の値が使われる)

|

||||

|

||||

[[datasets.subsets]]

|

||||

image_dir = 'C:\fuga'

|

||||

class_tokens = 'fuga boy'

|

||||

keep_tokens = 3

|

||||

|

||||

[[datasets.subsets]]

|

||||

is_reg = true

|

||||

image_dir = 'C:\reg'

|

||||

class_tokens = 'human'

|

||||

keep_tokens = 1

|

||||

|

||||

# これは fine tuning 方式のデータセット

|

||||

[[datasets]]

|

||||

resolution = [768, 768]

|

||||

batch_size = 2

|

||||

|

||||

[[datasets.subsets]]

|

||||

image_dir = 'C:\piyo'

|

||||

metadata_file = 'C:\piyo\piyo_md.json'

|

||||

# このサブセットは keep_tokens = 1 (general の値が使われる)

|

||||

```

|

||||

|

||||

この例では、3 つのディレクトリを DreamBooth 方式のデータセットとして 512x512 (batch size 4) で学習させ、1 つのディレクトリを fine tuning 方式のデータセットとして 768x768 (batch size 2) で学習させることになります。

|

||||

|

||||

## データセット・サブセットに関する設定

|

||||

|

||||

データセット・サブセットに関する設定は、登録可能な箇所がいくつかに分かれています。

|

||||

|

||||

* `[general]`

|

||||

* 全データセットまたは全サブセットに適用されるオプションを指定する箇所です。

|

||||

* データセットごとの設定及びサブセットごとの設定に同名のオプションが存在していた場合には、データセット・サブセットごとの設定が優先されます。

|

||||

* `[[datasets]]`

|

||||

* `datasets` はデータセットに関する設定の登録箇所になります。各データセットに個別に適用されるオプションを指定する箇所です。

|

||||

* サブセットごとの設定が存在していた場合には、サブセットごとの設定が優先されます。

|

||||

* `[[datasets.subsets]]`

|

||||

* `datasets.subsets` はサブセットに関する設定の登録箇所になります。各サブセットに個別に適用されるオプションを指定する箇所です。

|

||||

|

||||

先程の例における、画像ディレクトリと登録箇所の対応に関するイメージ図です。

|

||||

|

||||

```

|

||||

C:\

|

||||

├─ hoge -> [[datasets.subsets]] No.1 ┐ ┐

|

||||

├─ fuga -> [[datasets.subsets]] No.2 |-> [[datasets]] No.1 |-> [general]

|

||||

├─ reg -> [[datasets.subsets]] No.3 ┘ |

|

||||

└─ piyo -> [[datasets.subsets]] No.4 --> [[datasets]] No.2 ┘

|

||||

```

|

||||

|

||||

画像ディレクトリがそれぞれ1つの `[[datasets.subsets]]` に対応しています。そして `[[datasets.subsets]]` が1つ以上組み合わさって1つの `[[datasets]]` を構成します。`[general]` には全ての `[[datasets]]`, `[[datasets.subsets]]` が属します。

|

||||

|

||||

登録箇所ごとに指定可能なオプションは異なりますが、同名のオプションが指定された場合は下位の登録箇所にある値が優先されます。先程の例の `keep_tokens` オプションの扱われ方を確認してもらうと理解しやすいかと思います。

|

||||

|

||||

加えて、学習方法が対応している手法によっても指定可能なオプションが変化します。

|

||||

|

||||

* DreamBooth 方式専用のオプション

|

||||

* fine tuning 方式専用のオプション

|

||||

* caption dropout の手法が使える場合のオプション

|

||||

|

||||

DreamBooth の手法と fine tuning の手法の両方とも利用可能な学習方法では、両者を併用することができます。

|

||||

併用する際の注意点として、DreamBooth 方式なのか fine tuning 方式なのかはデータセット単位で判別を行っているため、同じデータセット中に DreamBooth 方式のサブセットと fine tuning 方式のサブセットを混在させることはできません。

|

||||

つまり、これらを併用したい場合には異なる方式のサブセットが異なるデータセットに所属するように設定する必要があります。

|

||||

|

||||

プログラムの挙動としては、後述する `metadata_file` オプションが存在していたら fine tuning 方式のサブセットだと判断します。

|

||||

そのため、同一のデータセットに所属するサブセットについて言うと、「全てが `metadata_file` オプションを持つ」か「全てが `metadata_file` オプションを持たない」かのどちらかになっていれば問題ありません。

|

||||

|

||||

以下、利用可能なオプションを説明します。コマンドライン引数と名称が同一のオプションについては、基本的に説明を割愛します。他の README を参照してください。

|

||||

|

||||

### 全学習方法で共通のオプション

|

||||

|

||||

学習方法によらずに指定可能なオプションです。

|

||||

|

||||

#### データセット向けオプション

|

||||

|

||||

データセットの設定に関わるオプションです。`datasets.subsets` には記述できません。

|

||||

|

||||

| オプション名 | 設定例 | `[general]` | `[[datasets]]` |

|

||||

| ---- | ---- | ---- | ---- |

|

||||

| `batch_size` | `1` | o | o |

|

||||

| `bucket_no_upscale` | `true` | o | o |

|

||||

| `bucket_reso_steps` | `64` | o | o |

|

||||

| `enable_bucket` | `true` | o | o |

|

||||

| `max_bucket_reso` | `1024` | o | o |

|

||||

| `min_bucket_reso` | `128` | o | o |

|

||||

| `resolution` | `256`, `[512, 512]` | o | o |

|

||||

|

||||

* `batch_size`

|

||||

* コマンドライン引数の `--train_batch_size` と同等です。

|

||||

|

||||

これらの設定はデータセットごとに固定です。

|

||||

つまり、データセットに所属するサブセットはこれらの設定を共有することになります。

|

||||

例えば解像度が異なるデータセットを用意したい場合は、上に挙げた例のように別々のデータセットとして定義すれば別々の解像度を設定可能です。

|

||||

|

||||

#### サブセット向けオプション

|

||||

|

||||

サブセットの設定に関わるオプションです。

|

||||

|

||||

| オプション名 | 設定例 | `[general]` | `[[datasets]]` | `[[dataset.subsets]]` |

|

||||

| ---- | ---- | ---- | ---- | ---- |

|

||||

| `color_aug` | `false` | o | o | o |

|

||||

| `face_crop_aug_range` | `[1.0, 3.0]` | o | o | o |

|

||||

| `flip_aug` | `true` | o | o | o |

|

||||

| `keep_tokens` | `2` | o | o | o |

|

||||

| `num_repeats` | `10` | o | o | o |

|

||||

| `random_crop` | `false` | o | o | o |

|

||||

| `shuffle_caption` | `true` | o | o | o |

|

||||

|

||||

* `num_repeats`

|

||||

* サブセットの画像の繰り返し回数を指定します。fine tuning における `--dataset_repeats` に相当しますが、`num_repeats` はどの学習方法でも指定可能です。

|

||||

|

||||

### DreamBooth 方式専用のオプション

|

||||

|

||||

DreamBooth 方式のオプションは、サブセット向けオプションのみ存在します。

|

||||

|

||||

#### サブセット向けオプション

|

||||

|

||||

DreamBooth 方式のサブセットの設定に関わるオプションです。

|

||||

|

||||

| オプション名 | 設定例 | `[general]` | `[[datasets]]` | `[[dataset.subsets]]` |

|

||||

| ---- | ---- | ---- | ---- | ---- |

|

||||

| `image_dir` | `‘C:\hoge’` | - | - | o(必須) |

|

||||

| `caption_extension` | `".txt"` | o | o | o |

|

||||

| `class_tokens` | `“sks girl”` | - | - | o |

|

||||

| `is_reg` | `false` | - | - | o |

|

||||

|

||||

まず注意点として、 `image_dir` には画像ファイルが直下に置かれているパスを指定する必要があります。従来の DreamBooth の手法ではサブディレクトリに画像を置く必要がありましたが、そちらとは仕様に互換性がありません。また、`5_cat` のようなフォルダ名にしても、画像の繰り返し回数とクラス名は反映されません。これらを個別に設定したい場合、`num_repeats` と `class_tokens` で明示的に指定する必要があることに注意してください。

|

||||

|

||||

* `image_dir`

|

||||

* 画像ディレクトリのパスを指定します。指定必須オプションです。

|

||||

* 画像はディレクトリ直下に置かれている必要があります。

|

||||

* `class_tokens`

|

||||

* クラストークンを設定します。

|

||||

* 画像に対応する caption ファイルが存在しない場合にのみ学習時に利用されます。利用するかどうかの判定は画像ごとに行います。`class_tokens` を指定しなかった場合に caption ファイルも見つからなかった場合にはエラーになります。

|

||||

* `is_reg`

|

||||

* サブセットの画像が正規化用かどうかを指定します。指定しなかった場合は `false` として、つまり正規化画像ではないとして扱います。

|

||||

|

||||

### fine tuning 方式専用のオプション

|

||||

|

||||

fine tuning 方式のオプションは、サブセット向けオプションのみ存在します。

|

||||

|

||||

#### サブセット向けオプション

|

||||

|

||||

fine tuning 方式のサブセットの設定に関わるオプションです。

|

||||

|

||||

| オプション名 | 設定例 | `[general]` | `[[datasets]]` | `[[dataset.subsets]]` |

|

||||

| ---- | ---- | ---- | ---- | ---- |

|

||||

| `image_dir` | `‘C:\hoge’` | - | - | o |

|

||||

| `metadata_file` | `'C:\piyo\piyo_md.json'` | - | - | o(必須) |

|

||||

|

||||

* `image_dir`

|

||||

* 画像ディレクトリのパスを指定します。DreamBooth の手法の方とは異なり指定は必須ではありませんが、設定することを推奨します。

|

||||

* 指定する必要がない状況としては、メタデータファイルの生成時に `--full_path` を付与して実行していた場合です。

|

||||

* 画像はディレクトリ直下に置かれている必要があります。

|

||||

* `metadata_file`

|

||||

* サブセットで利用されるメタデータファイルのパスを指定します。指定必須オプションです。

|

||||

* コマンドライン引数の `--in_json` と同等です。

|

||||

* サブセットごとにメタデータファイルを指定する必要がある仕様上、ディレクトリを跨いだメタデータを1つのメタデータファイルとして作成することは避けた方が良いでしょう。画像ディレクトリごとにメタデータファイルを用意し、それらを別々のサブセットとして登録することを強く推奨します。

|

||||

|

||||

### caption dropout の手法が使える場合に指定可能なオプション

|

||||

|

||||

caption dropout の手法が使える場合のオプションは、サブセット向けオプションのみ存在します。

|

||||

DreamBooth 方式か fine tuning 方式かに関わらず、caption dropout に対応している学習方法であれば指定可能です。

|

||||

|

||||

#### サブセット向けオプション

|

||||

|

||||

caption dropout が使えるサブセットの設定に関わるオプションです。

|

||||

|

||||

| オプション名 | `[general]` | `[[datasets]]` | `[[dataset.subsets]]` |

|

||||

| ---- | ---- | ---- | ---- |

|

||||

| `caption_dropout_every_n_epochs` | o | o | o |

|

||||

| `caption_dropout_rate` | o | o | o |

|

||||

| `caption_tag_dropout_rate` | o | o | o |

|

||||

|

||||

## 重複したサブセットが存在する時の挙動

|

||||

|

||||

DreamBooth 方式のデータセットの場合、その中にある `image_dir` が同一のサブセットは重複していると見なされます。

|

||||

fine tuning 方式のデータセットの場合は、その中にある `metadata_file` が同一のサブセットは重複していると見なされます。

|

||||

データセット中に重複したサブセットが存在する場合、2個目以降は無視されます。

|

||||

|

||||

一方、異なるデータセットに所属している場合は、重複しているとは見なされません。

|

||||

例えば、以下のように同一の `image_dir` を持つサブセットを別々のデータセットに入れた場合には、重複していないと見なします。

|

||||

これは、同じ画像でも異なる解像度で学習したい場合に役立ちます。

|

||||

|

||||

```toml

|

||||

# 別々のデータセットに存在している場合は重複とは見なされず、両方とも学習に使われる

|

||||

|

||||

[[datasets]]

|

||||

resolution = 512

|

||||

|

||||

[[datasets.subsets]]

|

||||

image_dir = 'C:\hoge'

|

||||

|

||||

[[datasets]]

|

||||

resolution = 768

|

||||

|

||||

[[datasets.subsets]]

|

||||

image_dir = 'C:\hoge'

|

||||

```

|

||||

|

||||

## コマンドライン引数との併用

|

||||

|

||||

設定ファイルのオプションの中には、コマンドライン引数のオプションと役割が重複しているものがあります。

|

||||

|

||||

以下に挙げるコマンドライン引数のオプションは、設定ファイルを渡した場合には無視されます。

|

||||

|

||||

* `--train_data_dir`

|

||||

* `--reg_data_dir`

|

||||

* `--in_json`

|

||||

|

||||

以下に挙げるコマンドライン引数のオプションは、コマンドライン引数と設定ファイルで同時に指定された場合、コマンドライン引数の値よりも設定ファイルの値が優先されます。特に断りがなければ同名のオプションとなります。

|

||||

|

||||

| コマンドライン引数のオプション | 優先される設定ファイルのオプション |

|

||||

| ---------------------------------- | ---------------------------------- |

|

||||

| `--bucket_no_upscale` | |

|

||||

| `--bucket_reso_steps` | |

|

||||

| `--caption_dropout_every_n_epochs` | |

|

||||

| `--caption_dropout_rate` | |

|

||||

| `--caption_extension` | |

|

||||

| `--caption_tag_dropout_rate` | |

|

||||

| `--color_aug` | |

|

||||

| `--dataset_repeats` | `num_repeats` |

|

||||

| `--enable_bucket` | |

|

||||

| `--face_crop_aug_range` | |

|

||||

| `--flip_aug` | |

|

||||

| `--keep_tokens` | |

|

||||

| `--min_bucket_reso` | |

|

||||

| `--random_crop` | |

|

||||

| `--resolution` | |

|

||||

| `--shuffle_caption` | |

|

||||

| `--train_batch_size` | `batch_size` |

|

||||

|

||||

## エラーの手引き

|

||||

|

||||

現在、外部ライブラリを利用して設定ファイルの記述が正しいかどうかをチェックしているのですが、整備が行き届いておらずエラーメッセージがわかりづらいという問題があります。

|

||||

将来的にはこの問題の改善に取り組む予定です。

|

||||

|

||||

次善策として、頻出のエラーとその対処法について載せておきます。

|

||||

正しいはずなのにエラーが出る場合、エラー内容がどうしても分からない場合は、バグかもしれないのでご連絡ください。

|

||||

|

||||

* `voluptuous.error.MultipleInvalid: required key not provided @ ...`: 指定必須のオプションが指定されていないというエラーです。指定を忘れているか、オプション名を間違って記述している可能性が高いです。

|

||||

* `...` の箇所にはエラーが発生した場所が載っています。例えば `voluptuous.error.MultipleInvalid: required key not provided @ data['datasets'][0]['subsets'][0]['image_dir']` のようなエラーが出たら、0 番目の `datasets` 中の 0 番目の `subsets` の設定に `image_dir` が存在しないということになります。

|

||||

* `voluptuous.error.MultipleInvalid: expected int for dictionary value @ ...`: 指定する値の形式が不正というエラーです。値の形式が間違っている可能性が高いです。`int` の部分は対象となるオプションによって変わります。この README に載っているオプションの「設定例」が役立つかもしれません。

|

||||

* `voluptuous.error.MultipleInvalid: extra keys not allowed @ ...`: 対応していないオプション名が存在している場合に発生するエラーです。オプション名を間違って記述しているか、誤って紛れ込んでいる可能性が高いです。

|

||||

|

||||

|

||||

642

fine_tune.py

642

fine_tune.py

@@ -5,6 +5,8 @@ import argparse

|

||||

import gc

|

||||

import math

|

||||

import os

|

||||

import toml

|

||||

from multiprocessing import Value

|

||||

|

||||

from tqdm import tqdm

|

||||

import torch

|

||||

@@ -13,324 +15,416 @@ import diffusers

|

||||

from diffusers import DDPMScheduler

|

||||

|

||||

import library.train_util as train_util

|

||||

|

||||

|

||||

def collate_fn(examples):

|

||||

return examples[0]

|

||||

import library.config_util as config_util

|

||||

from library.config_util import (

|

||||

ConfigSanitizer,

|

||||

BlueprintGenerator,

|

||||

)

|

||||

import library.custom_train_functions as custom_train_functions

|

||||

from library.custom_train_functions import apply_snr_weight

|

||||

|

||||

|

||||

def train(args):

|

||||

train_util.verify_training_args(args)

|

||||

train_util.prepare_dataset_args(args, True)

|

||||

train_util.verify_training_args(args)

|

||||

train_util.prepare_dataset_args(args, True)

|

||||

|

||||

cache_latents = args.cache_latents

|

||||

cache_latents = args.cache_latents

|

||||

|

||||

if args.seed is not None:

|

||||

set_seed(args.seed) # 乱数系列を初期化する

|

||||

if args.seed is not None:

|

||||

set_seed(args.seed) # 乱数系列を初期化する

|

||||

|

||||

tokenizer = train_util.load_tokenizer(args)

|

||||

tokenizer = train_util.load_tokenizer(args)

|

||||

|

||||

train_dataset = train_util.FineTuningDataset(args.in_json, args.train_batch_size, args.train_data_dir,

|

||||

tokenizer, args.max_token_length, args.shuffle_caption, args.keep_tokens,

|

||||

args.resolution, args.enable_bucket, args.min_bucket_reso, args.max_bucket_reso,

|

||||

args.flip_aug, args.color_aug, args.face_crop_aug_range, args.random_crop,

|

||||

args.dataset_repeats, args.debug_dataset)

|

||||

train_dataset.make_buckets()

|

||||

|

||||

if args.debug_dataset:

|

||||

train_util.debug_dataset(train_dataset)

|

||||

return

|

||||

if len(train_dataset) == 0:

|

||||

print("No data found. Please verify the metadata file and train_data_dir option. / 画像がありません。メタデータおよびtrain_data_dirオプションを確認してください。")

|

||||

return

|

||||

|

||||

# acceleratorを準備する

|

||||

print("prepare accelerator")

|

||||

accelerator, unwrap_model = train_util.prepare_accelerator(args)

|

||||

|

||||

# mixed precisionに対応した型を用意しておき適宜castする

|

||||

weight_dtype, save_dtype = train_util.prepare_dtype(args)

|

||||

|

||||

# モデルを読み込む

|

||||

text_encoder, vae, unet, load_stable_diffusion_format = train_util.load_target_model(args, weight_dtype)

|

||||

|

||||

# verify load/save model formats

|

||||

if load_stable_diffusion_format:

|

||||

src_stable_diffusion_ckpt = args.pretrained_model_name_or_path

|

||||

src_diffusers_model_path = None

|

||||

else:

|

||||

src_stable_diffusion_ckpt = None

|

||||

src_diffusers_model_path = args.pretrained_model_name_or_path

|

||||

|

||||

if args.save_model_as is None:

|

||||

save_stable_diffusion_format = load_stable_diffusion_format

|

||||

use_safetensors = args.use_safetensors

|

||||

else:

|

||||

save_stable_diffusion_format = args.save_model_as.lower() == 'ckpt' or args.save_model_as.lower() == 'safetensors'

|

||||

use_safetensors = args.use_safetensors or ("safetensors" in args.save_model_as.lower())

|

||||

|

||||

# Diffusers版のxformers使用フラグを設定する関数

|

||||

def set_diffusers_xformers_flag(model, valid):

|

||||

# model.set_use_memory_efficient_attention_xformers(valid) # 次のリリースでなくなりそう

|

||||

# pipeが自動で再帰的にset_use_memory_efficient_attention_xformersを探すんだって(;´Д`)

|

||||

# U-Netだけ使う時にはどうすればいいのか……仕方ないからコピって使うか

|

||||

# 0.10.2でなんか巻き戻って個別に指定するようになった(;^ω^)

|

||||

|

||||