mirror of

https://github.com/kohya-ss/sd-scripts.git

synced 2026-04-06 21:52:27 +00:00

Compare commits

36 Commits

| Author | SHA1 | Date | |

|---|---|---|---|

|

|

bda0e8333c | ||

|

|

f192338874 | ||

|

|

885fd9ec90 | ||

|

|

0f20453997 | ||

|

|

8215f12c45 | ||

|

|

64de791f2c | ||

|

|

7e51bd837e | ||

|

|

eed13e6cb5 | ||

|

|

7ada935dfc | ||

|

|

a39a3b4a3d | ||

|

|

445b34de1f | ||

|

|

96d695dd83 | ||

|

|

da05ad6339 | ||

|

|

bda3c7f27a | ||

|

|

3800e145bd | ||

|

|

d904bb76c0 | ||

|

|

0a884da984 | ||

|

|

689c8414df | ||

|

|

02b1b2b8fe | ||

|

|

5f6eb13df9 | ||

|

|

0f398fea65 | ||

|

|

4b68913dbe | ||

|

|

890f6d5a9c | ||

|

|

cf7832fbb1 | ||

|

|

dfbecbc4d7 | ||

|

|

600d78ae08 | ||

|

|

504e27af18 | ||

|

|

ca85f18eae | ||

|

|

dadea12ad2 | ||

|

|

e53adbdbcc | ||

|

|

20055752bd | ||

|

|

7cca345345 | ||

|

|

5f7693be04 | ||

|

|

d9bb4aa4f9 | ||

|

|

c5cca931ab | ||

|

|

bedea62ff0 |

3

.gitignore

vendored

3

.gitignore

vendored

@@ -1,3 +1,6 @@

|

||||

logs

|

||||

__pycache__

|

||||

wd14_tagger_model

|

||||

venv

|

||||

*.egg-info

|

||||

build

|

||||

112

README-ja.md

112

README-ja.md

@@ -14,10 +14,110 @@ GUIやPowerShellスクリプトなど、より使いやすくする機能が[bma

|

||||

|

||||

## 使用法について

|

||||

|

||||

note.comに記事がありますのでそちらをご覧ください(将来的にはこちらへ移すかもしれません)。

|

||||

当リポジトリ内およびnote.comに記事がありますのでそちらをご覧ください(将来的にはすべてこちらへ移すかもしれません)。

|

||||

|

||||

* note.com [環境整備とDreamBooth学習スクリプトについて](https://note.com/kohya_ss/n/nba4eceaa4594)

|

||||

* [fine-tuningのガイド](./fine_tune_README_ja.md):

|

||||

BLIPによるキャプショニングと、DeepDanbooruまたはWD14 taggerによるタグ付けを含みます

|

||||

* note.com [画像生成スクリプト](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* note.com [モデル変換スクリプト](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

|

||||

## Windowsでの動作に必要なプログラム

|

||||

|

||||

Python 3.10.6およびGitが必要です。

|

||||

|

||||

- Python 3.10.6: https://www.python.org/ftp/python/3.10.6/python-3.10.6-amd64.exe

|

||||

- git: https://git-scm.com/download/win

|

||||

|

||||

PowerShellを使う場合、venvを使えるようにするためには以下の手順でセキュリティ設定を変更してください。

|

||||

(venvに限らずスクリプトの実行が可能になりますので注意してください。)

|

||||

|

||||

- PowerShellを管理者として開きます。

|

||||

- 「Set-ExecutionPolicy Unrestricted」と入力し、Yと答えます。

|

||||

- 管理者のPowerShellを閉じます。

|

||||

|

||||

## Windows環境でのインストール

|

||||

|

||||

以下の例ではPyTorchは1.12.1/CUDA 11.6版をインストールします。CUDA 11.3版やPyTorch 1.13を使う場合は適宜書き換えください。

|

||||

|

||||

(なお、python -m venv~の行で「python」とだけ表示された場合、py -m venv~のようにpythonをpyに変更してください。)

|

||||

|

||||

通常の(管理者ではない)PowerShellを開き以下を順に実行します。

|

||||

|

||||

|

||||

```powershell

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

pip install --upgrade -r requirements.txt

|

||||

pip install -U -I --no-deps https://github.com/C43H66N12O12S2/stable-diffusion-webui/releases/download/f/xformers-0.0.14.dev0-cp310-cp310-win_amd64.whl

|

||||

|

||||

cp .\bitsandbytes_windows\*.dll .\venv\Lib\site-packages\bitsandbytes\

|

||||

cp .\bitsandbytes_windows\cextension.py .\venv\Lib\site-packages\bitsandbytes\cextension.py

|

||||

cp .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cuda_setup\main.py

|

||||

|

||||

accelerate config

|

||||

```

|

||||

|

||||

コマンドプロンプトでは以下になります。

|

||||

|

||||

|

||||

```bat

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

pip install --upgrade -r requirements.txt

|

||||

pip install -U -I --no-deps https://github.com/C43H66N12O12S2/stable-diffusion-webui/releases/download/f/xformers-0.0.14.dev0-cp310-cp310-win_amd64.whl

|

||||

|

||||

copy /y .\bitsandbytes_windows\*.dll .\venv\Lib\site-packages\bitsandbytes\

|

||||

copy /y .\bitsandbytes_windows\cextension.py .\venv\Lib\site-packages\bitsandbytes\cextension.py

|

||||

copy /y .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cuda_setup\main.py

|

||||

|

||||

accelerate config

|

||||

```

|

||||

|

||||

accelerate configの質問には以下のように答えてください。(bf16で学習する場合、最後の質問にはbf16と答えてください。)

|

||||

|

||||

※0.15.0から日本語環境では選択のためにカーソルキーを押すと落ちます(……)。数字キーの0、1、2……で選択できますので、そちらを使ってください。

|

||||

|

||||

```txt

|

||||

- 0

|

||||

- 0

|

||||

- NO

|

||||

- NO

|

||||

- All

|

||||

- fp16

|

||||

```

|

||||

|

||||

## アップグレード

|

||||

|

||||

新しいリリースがあった場合、以下のコマンドで更新できます。

|

||||

|

||||

```powershell

|

||||

cd sd-scripts

|

||||

git pull

|

||||

.\venv\Scripts\activate

|

||||

pip install --upgrade -r <requirement file name>

|

||||

```

|

||||

|

||||

コマンドが成功すれば新しいバージョンが使用できます。

|

||||

|

||||

## ライセンス

|

||||

|

||||

スクリプトのライセンスはASL 2.0ですが、一部他のライセンスのコードを含みます。

|

||||

|

||||

[Memory Efficient Attention Pytorch](https://github.com/lucidrains/memory-efficient-attention-pytorch): MIT

|

||||

|

||||

[bitsandbytes](https://github.com/TimDettmers/bitsandbytes): MIT

|

||||

|

||||

[BLIP](https://github.com/salesforce/BLIP): BSD-3-Clause

|

||||

|

||||

|

||||

* [環境整備とDreamBooth学習スクリプトについて](https://note.com/kohya_ss/n/nee3ed1649fb6)

|

||||

* [fine-tuningスクリプト](https://note.com/kohya_ss/n/nbf7ce8d80f29):

|

||||

Including BLIP captioning and tagging by DeepDanbooru or WD14 tagger

|

||||

* [画像生成スクリプト](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* [モデル変換スクリプト](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

|

||||

86

README.md

86

README.md

@@ -11,18 +11,90 @@ This repository contains the scripts for:

|

||||

* image generation

|

||||

* model conversion (supports 1.x and 2.x, Stable Diffision ckpt/safetensors and Diffusers)

|

||||

|

||||

## About requirements_*.txt

|

||||

## About requirements.txt

|

||||

|

||||

These files do not contain requirements for PyTorch and Diffusers. Because the versions of them depend on your environment. Please install PyTorch at first, then Diffusers.

|

||||

These files do not contain requirements for PyTorch. Because the versions of them depend on your environment. Please install PyTorch at first (see installation guide below.)

|

||||

|

||||

The scripts is tested with PyTorch 1.12.1 and 1.13.0, Diffusers 0.10.2.

|

||||

The scripts are tested with PyTorch 1.12.1 and 1.13.0, Diffusers 0.10.2.

|

||||

|

||||

## Links to how-to-use documents

|

||||

|

||||

All documents are in Japanese currently, and CUI based.

|

||||

|

||||

* [Environment setup and DreamBooth training guide](https://note.com/kohya_ss/n/nee3ed1649fb6)

|

||||

* [Fine-tuning step-by-step guide](https://note.com/kohya_ss/n/nbf7ce8d80f29):

|

||||

* note.com [Environment setup and DreamBooth training guide](https://note.com/kohya_ss/n/nba4eceaa4594)

|

||||

* [Step by Step fine-tuning guide](./fine_tune_README_ja.md):

|

||||

Including BLIP captioning and tagging by DeepDanbooru or WD14 tagger

|

||||

* [Image generation](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* [Model conversion](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

* [training LoRA](./train_network_README-ja.md)

|

||||

* note.com [Image generation](https://note.com/kohya_ss/n/n2693183a798e)

|

||||

* note.com [Model conversion](https://note.com/kohya_ss/n/n374f316fe4ad)

|

||||

|

||||

## Windows Required Dependencies

|

||||

|

||||

Python 3.10.6 and Git:

|

||||

|

||||

- Python 3.10.6: https://www.python.org/ftp/python/3.10.6/python-3.10.6-amd64.exe

|

||||

- git: https://git-scm.com/download/win

|

||||

|

||||

Give unrestricted script access to powershell so venv can work:

|

||||

|

||||

- Open an administrator powershell window

|

||||

- Type `Set-ExecutionPolicy Unrestricted` and answer A

|

||||

- Close admin powershell window

|

||||

|

||||

## Windows Installation

|

||||

|

||||

Open a regular Powershell terminal and type the following inside:

|

||||

|

||||

```powershell

|

||||

git clone https://github.com/kohya-ss/sd-scripts.git

|

||||

cd sd-scripts

|

||||

|

||||

python -m venv --system-site-packages venv

|

||||

.\venv\Scripts\activate

|

||||

|

||||

pip install torch==1.12.1+cu116 torchvision==0.13.1+cu116 --extra-index-url https://download.pytorch.org/whl/cu116

|

||||

pip install --upgrade -r requirements.txt

|

||||

pip install -U -I --no-deps https://github.com/C43H66N12O12S2/stable-diffusion-webui/releases/download/f/xformers-0.0.14.dev0-cp310-cp310-win_amd64.whl

|

||||

|

||||

cp .\bitsandbytes_windows\*.dll .\venv\Lib\site-packages\bitsandbytes\

|

||||

cp .\bitsandbytes_windows\cextension.py .\venv\Lib\site-packages\bitsandbytes\cextension.py

|

||||

cp .\bitsandbytes_windows\main.py .\venv\Lib\site-packages\bitsandbytes\cuda_setup\main.py

|

||||

|

||||

accelerate config

|

||||

|

||||

```

|

||||

|

||||

Answers to accelerate config:

|

||||

|

||||

```txt

|

||||

- 0

|

||||

- 0

|

||||

- NO

|

||||

- NO

|

||||

- All

|

||||

- fp16

|

||||

```

|

||||

|

||||

## Upgrade

|

||||

|

||||

When a new release comes out you can upgrade your repo with the following command:

|

||||

|

||||

```powershell

|

||||

cd sd-scripts

|

||||

git pull

|

||||

.\venv\Scripts\activate

|

||||

pip install --upgrade -r requirements.txt

|

||||

```

|

||||

|

||||

Once the commands have completed successfully you should be ready to use the new version.

|

||||

|

||||

## License

|

||||

|

||||

The majority of scripts is licensed under ASL 2.0 (including codes from Diffusers), however portions of the project are available under separate license terms:

|

||||

|

||||

[Memory Efficient Attention Pytorch](https://github.com/lucidrains/memory-efficient-attention-pytorch): MIT

|

||||

|

||||

[bitsandbytes](https://github.com/TimDettmers/bitsandbytes): MIT

|

||||

|

||||

[BLIP](https://github.com/salesforce/BLIP): BSD-3-Clause

|

||||

|

||||

|

||||

54

bitsandbytes_windows/cextension.py

Normal file

54

bitsandbytes_windows/cextension.py

Normal file

@@ -0,0 +1,54 @@

|

||||

import ctypes as ct

|

||||

from pathlib import Path

|

||||

from warnings import warn

|

||||

|

||||

from .cuda_setup.main import evaluate_cuda_setup

|

||||

|

||||

|

||||

class CUDALibrary_Singleton(object):

|

||||

_instance = None

|

||||

|

||||

def __init__(self):

|

||||

raise RuntimeError("Call get_instance() instead")

|

||||

|

||||

def initialize(self):

|

||||

binary_name = evaluate_cuda_setup()

|

||||

package_dir = Path(__file__).parent

|

||||

binary_path = package_dir / binary_name

|

||||

|

||||

if not binary_path.exists():

|

||||

print(f"CUDA SETUP: TODO: compile library for specific version: {binary_name}")

|

||||

legacy_binary_name = "libbitsandbytes.so"

|

||||

print(f"CUDA SETUP: Defaulting to {legacy_binary_name}...")

|

||||

binary_path = package_dir / legacy_binary_name

|

||||

if not binary_path.exists():

|

||||

print('CUDA SETUP: CUDA detection failed. Either CUDA driver not installed, CUDA not installed, or you have multiple conflicting CUDA libraries!')

|

||||

print('CUDA SETUP: If you compiled from source, try again with `make CUDA_VERSION=DETECTED_CUDA_VERSION` for example, `make CUDA_VERSION=113`.')

|

||||

raise Exception('CUDA SETUP: Setup Failed!')

|

||||

# self.lib = ct.cdll.LoadLibrary(binary_path)

|

||||

self.lib = ct.cdll.LoadLibrary(str(binary_path)) # $$$

|

||||

else:

|

||||

print(f"CUDA SETUP: Loading binary {binary_path}...")

|

||||

# self.lib = ct.cdll.LoadLibrary(binary_path)

|

||||

self.lib = ct.cdll.LoadLibrary(str(binary_path)) # $$$

|

||||

|

||||

@classmethod

|

||||

def get_instance(cls):

|

||||

if cls._instance is None:

|

||||

cls._instance = cls.__new__(cls)

|

||||

cls._instance.initialize()

|

||||

return cls._instance

|

||||

|

||||

|

||||

lib = CUDALibrary_Singleton.get_instance().lib

|

||||

try:

|

||||

lib.cadam32bit_g32

|

||||

lib.get_context.restype = ct.c_void_p

|

||||

lib.get_cusparse.restype = ct.c_void_p

|

||||

COMPILED_WITH_CUDA = True

|

||||

except AttributeError:

|

||||

warn(

|

||||

"The installed version of bitsandbytes was compiled without GPU support. "

|

||||

"8-bit optimizers and GPU quantization are unavailable."

|

||||

)

|

||||

COMPILED_WITH_CUDA = False

|

||||

BIN

bitsandbytes_windows/libbitsandbytes_cpu.dll

Normal file

BIN

bitsandbytes_windows/libbitsandbytes_cpu.dll

Normal file

Binary file not shown.

BIN

bitsandbytes_windows/libbitsandbytes_cuda116.dll

Normal file

BIN

bitsandbytes_windows/libbitsandbytes_cuda116.dll

Normal file

Binary file not shown.

166

bitsandbytes_windows/main.py

Normal file

166

bitsandbytes_windows/main.py

Normal file

@@ -0,0 +1,166 @@

|

||||

"""

|

||||

extract factors the build is dependent on:

|

||||

[X] compute capability

|

||||

[ ] TODO: Q - What if we have multiple GPUs of different makes?

|

||||

- CUDA version

|

||||

- Software:

|

||||

- CPU-only: only CPU quantization functions (no optimizer, no matrix multiple)

|

||||

- CuBLAS-LT: full-build 8-bit optimizer

|

||||

- no CuBLAS-LT: no 8-bit matrix multiplication (`nomatmul`)

|

||||

|

||||

evaluation:

|

||||

- if paths faulty, return meaningful error

|

||||

- else:

|

||||

- determine CUDA version

|

||||

- determine capabilities

|

||||

- based on that set the default path

|

||||

"""

|

||||

|

||||

import ctypes

|

||||

|

||||

from .paths import determine_cuda_runtime_lib_path

|

||||

|

||||

|

||||

def check_cuda_result(cuda, result_val):

|

||||

# 3. Check for CUDA errors

|

||||

if result_val != 0:

|

||||

error_str = ctypes.c_char_p()

|

||||

cuda.cuGetErrorString(result_val, ctypes.byref(error_str))

|

||||

print(f"CUDA exception! Error code: {error_str.value.decode()}")

|

||||

|

||||

def get_cuda_version(cuda, cudart_path):

|

||||

# https://docs.nvidia.com/cuda/cuda-runtime-api/group__CUDART____VERSION.html#group__CUDART____VERSION

|

||||

try:

|

||||

cudart = ctypes.CDLL(cudart_path)

|

||||

except OSError:

|

||||

# TODO: shouldn't we error or at least warn here?

|

||||

print(f'ERROR: libcudart.so could not be read from path: {cudart_path}!')

|

||||

return None

|

||||

|

||||

version = ctypes.c_int()

|

||||

check_cuda_result(cuda, cudart.cudaRuntimeGetVersion(ctypes.byref(version)))

|

||||

version = int(version.value)

|

||||

major = version//1000

|

||||

minor = (version-(major*1000))//10

|

||||

|

||||

if major < 11:

|

||||

print('CUDA SETUP: CUDA version lower than 11 are currently not supported for LLM.int8(). You will be only to use 8-bit optimizers and quantization routines!!')

|

||||

|

||||

return f'{major}{minor}'

|

||||

|

||||

|

||||

def get_cuda_lib_handle():

|

||||

# 1. find libcuda.so library (GPU driver) (/usr/lib)

|

||||

try:

|

||||

cuda = ctypes.CDLL("libcuda.so")

|

||||

except OSError:

|

||||

# TODO: shouldn't we error or at least warn here?

|

||||

print('CUDA SETUP: WARNING! libcuda.so not found! Do you have a CUDA driver installed? If you are on a cluster, make sure you are on a CUDA machine!')

|

||||

return None

|

||||

check_cuda_result(cuda, cuda.cuInit(0))

|

||||

|

||||

return cuda

|

||||

|

||||

|

||||

def get_compute_capabilities(cuda):

|

||||

"""

|

||||

1. find libcuda.so library (GPU driver) (/usr/lib)

|

||||

init_device -> init variables -> call function by reference

|

||||

2. call extern C function to determine CC

|

||||

(https://docs.nvidia.com/cuda/cuda-driver-api/group__CUDA__DEVICE__DEPRECATED.html)

|

||||

3. Check for CUDA errors

|

||||

https://stackoverflow.com/questions/14038589/what-is-the-canonical-way-to-check-for-errors-using-the-cuda-runtime-api

|

||||

# bits taken from https://gist.github.com/f0k/63a664160d016a491b2cbea15913d549

|

||||

"""

|

||||

|

||||

|

||||

nGpus = ctypes.c_int()

|

||||

cc_major = ctypes.c_int()

|

||||

cc_minor = ctypes.c_int()

|

||||

|

||||

device = ctypes.c_int()

|

||||

|

||||

check_cuda_result(cuda, cuda.cuDeviceGetCount(ctypes.byref(nGpus)))

|

||||

ccs = []

|

||||

for i in range(nGpus.value):

|

||||

check_cuda_result(cuda, cuda.cuDeviceGet(ctypes.byref(device), i))

|

||||

ref_major = ctypes.byref(cc_major)

|

||||

ref_minor = ctypes.byref(cc_minor)

|

||||

# 2. call extern C function to determine CC

|

||||

check_cuda_result(

|

||||

cuda, cuda.cuDeviceComputeCapability(ref_major, ref_minor, device)

|

||||

)

|

||||

ccs.append(f"{cc_major.value}.{cc_minor.value}")

|

||||

|

||||

return ccs

|

||||

|

||||

|

||||

# def get_compute_capability()-> Union[List[str, ...], None]: # FIXME: error

|

||||

def get_compute_capability(cuda):

|

||||

"""

|

||||

Extracts the highest compute capbility from all available GPUs, as compute

|

||||

capabilities are downwards compatible. If no GPUs are detected, it returns

|

||||

None.

|

||||

"""

|

||||

ccs = get_compute_capabilities(cuda)

|

||||

if ccs is not None:

|

||||

# TODO: handle different compute capabilities; for now, take the max

|

||||

return ccs[-1]

|

||||

return None

|

||||

|

||||

|

||||

def evaluate_cuda_setup():

|

||||

print('')

|

||||

print('='*35 + 'BUG REPORT' + '='*35)

|

||||

print('Welcome to bitsandbytes. For bug reports, please submit your error trace to: https://github.com/TimDettmers/bitsandbytes/issues')

|

||||

print('For effortless bug reporting copy-paste your error into this form: https://docs.google.com/forms/d/e/1FAIpQLScPB8emS3Thkp66nvqwmjTEgxp8Y9ufuWTzFyr9kJ5AoI47dQ/viewform?usp=sf_link')

|

||||

print('='*80)

|

||||

return "libbitsandbytes_cuda116.dll" # $$$

|

||||

|

||||

binary_name = "libbitsandbytes_cpu.so"

|

||||

#if not torch.cuda.is_available():

|

||||

#print('No GPU detected. Loading CPU library...')

|

||||

#return binary_name

|

||||

|

||||

cudart_path = determine_cuda_runtime_lib_path()

|

||||

if cudart_path is None:

|

||||

print(

|

||||

"WARNING: No libcudart.so found! Install CUDA or the cudatoolkit package (anaconda)!"

|

||||

)

|

||||

return binary_name

|

||||

|

||||

print(f"CUDA SETUP: CUDA runtime path found: {cudart_path}")

|

||||

cuda = get_cuda_lib_handle()

|

||||

cc = get_compute_capability(cuda)

|

||||

print(f"CUDA SETUP: Highest compute capability among GPUs detected: {cc}")

|

||||

cuda_version_string = get_cuda_version(cuda, cudart_path)

|

||||

|

||||

|

||||

if cc == '':

|

||||

print(

|

||||

"WARNING: No GPU detected! Check your CUDA paths. Processing to load CPU-only library..."

|

||||

)

|

||||

return binary_name

|

||||

|

||||

# 7.5 is the minimum CC vor cublaslt

|

||||

has_cublaslt = cc in ["7.5", "8.0", "8.6"]

|

||||

|

||||

# TODO:

|

||||

# (1) CUDA missing cases (no CUDA installed by CUDA driver (nvidia-smi accessible)

|

||||

# (2) Multiple CUDA versions installed

|

||||

|

||||

# we use ls -l instead of nvcc to determine the cuda version

|

||||

# since most installations will have the libcudart.so installed, but not the compiler

|

||||

print(f'CUDA SETUP: Detected CUDA version {cuda_version_string}')

|

||||

|

||||

def get_binary_name():

|

||||

"if not has_cublaslt (CC < 7.5), then we have to choose _nocublaslt.so"

|

||||

bin_base_name = "libbitsandbytes_cuda"

|

||||

if has_cublaslt:

|

||||

return f"{bin_base_name}{cuda_version_string}.so"

|

||||

else:

|

||||

return f"{bin_base_name}{cuda_version_string}_nocublaslt.so"

|

||||

|

||||

binary_name = get_binary_name()

|

||||

|

||||

return binary_name

|

||||

@@ -50,7 +50,7 @@ import numpy as np

|

||||

from einops import rearrange

|

||||

from torch import einsum

|

||||

|

||||

import model_util

|

||||

import library.model_util as model_util

|

||||

|

||||

# Tokenizer: checkpointから読み込むのではなくあらかじめ提供されているものを使う

|

||||

TOKENIZER_PATH = "openai/clip-vit-large-patch14"

|

||||

@@ -540,7 +540,7 @@ def train(args):

|

||||

|

||||

# v4で更新:clip_sample=Falseに

|

||||

# Diffusersのtrain_dreambooth.pyがconfigから持ってくるように変更されたので、clip_sample=Falseになるため、それに合わせる

|

||||

# 既存の1.4/1.5/2.0/2.1はすべてschdulerのconfigは(クラス名を除いて)同じ

|

||||

# 既存の1.4/1.5/2.0/2.1はすべてschedulerのconfigは(クラス名を除いて)同じ

|

||||

# よくソースを見たら学習時はclip_sampleは関係ないや(;'∀')

|

||||

noise_scheduler = DDPMScheduler(beta_start=0.00085, beta_end=0.012, beta_schedule="scaled_linear",

|

||||

num_train_timesteps=1000, clip_sample=False)

|

||||

|

||||

465

fine_tune_README_ja.md

Normal file

465

fine_tune_README_ja.md

Normal file

@@ -0,0 +1,465 @@

|

||||

NovelAIの提案した学習手法、自動キャプションニング、タグ付け、Windows+VRAM 12GB(v1.4/1.5の場合)環境等に対応したfine tuningです。

|

||||

|

||||

## 概要

|

||||

Diffusersを用いてStable DiffusionのU-Netのfine tuningを行います。NovelAIの記事にある以下の改善に対応しています(Aspect Ratio BucketingについてはNovelAIのコードを参考にしましたが、最終的なコードはすべてオリジナルです)。

|

||||

|

||||

* CLIP(Text Encoder)の最後の層ではなく最後から二番目の層の出力を用いる。

|

||||

* 正方形以外の解像度での学習(Aspect Ratio Bucketing) 。

|

||||

* トークン長を75から225に拡張する。

|

||||

* BLIPによるキャプショニング(キャプションの自動作成)、DeepDanbooruまたはWD14Taggerによる自動タグ付けを行う。

|

||||

* Hypernetworkの学習にも対応する。

|

||||

* Stable Diffusion v2.0(baseおよび768/v)に対応。

|

||||

* VAEの出力をあらかじめ取得しディスクに保存しておくことで、学習の省メモリ化、高速化を図る。

|

||||

|

||||

デフォルトではText Encoderの学習は行いません。モデル全体のfine tuningではU-Netだけを学習するのが一般的なようです(NovelAIもそのようです)。オプション指定でText Encoderも学習対象とできます。

|

||||

|

||||

## 追加機能について

|

||||

### CLIPの出力の変更

|

||||

プロンプトを画像に反映するため、テキストの特徴量への変換を行うのがCLIP(Text Encoder)です。Stable DiffusionではCLIPの最後の層の出力を用いていますが、それを最後から二番目の層の出力を用いるよう変更できます。NovelAIによると、これによりより正確にプロンプトが反映されるようになるとのことです。

|

||||

元のまま、最後の層の出力を用いることも可能です。

|

||||

※Stable Diffusion 2.0では最後から二番目の層をデフォルトで使います。clip_skipオプションを指定しないでください。

|

||||

|

||||

### 正方形以外の解像度での学習

|

||||

Stable Diffusionは512\*512で学習されていますが、それに加えて256\*1024や384\*640といった解像度でも学習します。これによりトリミングされる部分が減り、より正しくプロンプトと画像の関係が学習されることが期待されます。

|

||||

学習解像度はパラメータとして与えられた解像度の面積(=メモリ使用量)を超えない範囲で、64ピクセル単位で縦横に調整、作成されます。

|

||||

|

||||

機械学習では入力サイズをすべて統一するのが一般的ですが、特に制約があるわけではなく、実際は同一のバッチ内で統一されていれば大丈夫です。NovelAIの言うbucketingは、あらかじめ教師データを、アスペクト比に応じた学習解像度ごとに分類しておくことを指しているようです。そしてバッチを各bucket内の画像で作成することで、バッチの画像サイズを統一します。

|

||||

|

||||

### トークン長の75から225への拡張

|

||||

Stable Diffusionでは最大75トークン(開始・終了を含むと77トークン)ですが、それを225トークンまで拡張します。

|

||||

ただしCLIPが受け付ける最大長は75トークンですので、225トークンの場合、単純に三分割してCLIPを呼び出してから結果を連結しています。

|

||||

|

||||

※これが望ましい実装なのかどうかはいまひとつわかりません。とりあえず動いてはいるようです。特に2.0では何も参考になる実装がないので独自に実装してあります。

|

||||

|

||||

※Automatic1111氏のWeb UIではカンマを意識して分割、といったこともしているようですが、私の場合はそこまでしておらず単純な分割です。

|

||||

|

||||

## 環境整備

|

||||

|

||||

このリポジトリの[README](./README-ja.md)を参照してください。

|

||||

|

||||

## 教師データの用意

|

||||

|

||||

学習させたい画像データを用意し、任意のフォルダに入れてください。リサイズ等の事前の準備は必要ありません。

|

||||

ただし学習解像度よりもサイズが小さい画像については、超解像などで品質を保ったまま拡大しておくことをお勧めします。

|

||||

|

||||

複数の教師データフォルダにも対応しています。前処理をそれぞれのフォルダに対して実行する形となります。

|

||||

|

||||

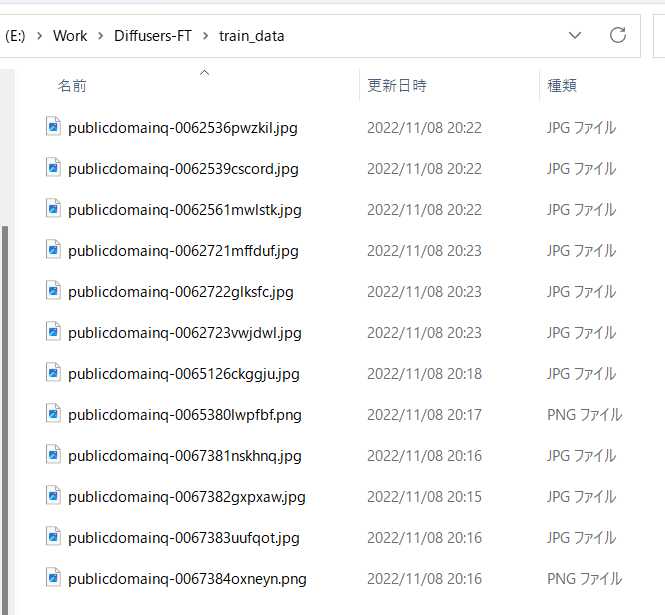

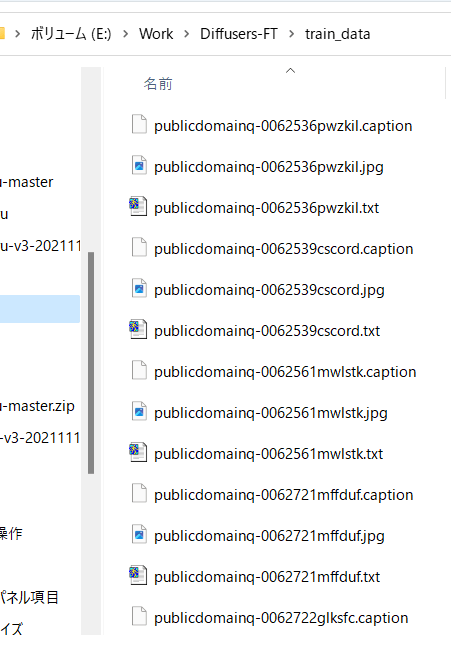

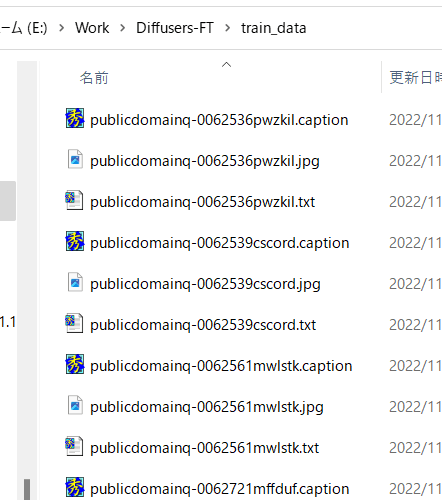

たとえば以下のように画像を格納します。

|

||||

|

||||

|

||||

|

||||

## 自動キャプショニング

|

||||

キャプションを使わずタグだけで学習する場合はスキップしてください。

|

||||

|

||||

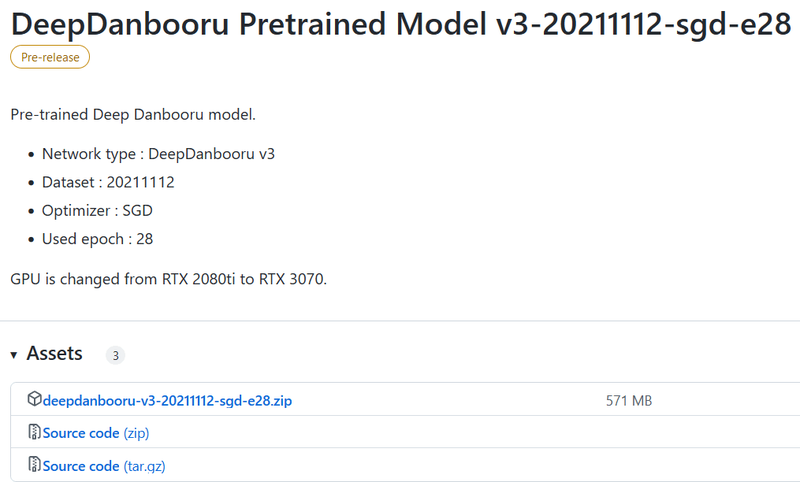

また手動でキャプションを用意する場合、キャプションは教師データ画像と同じディレクトリに、同じファイル名、拡張子.caption等で用意してください。各ファイルは1行のみのテキストファイルとします。

|

||||

|

||||

### BLIPによるキャプショニング

|

||||

|

||||

最新版ではBLIPのダウンロード、重みのダウンロード、仮想環境の追加は不要になりました。そのままで動作します。

|

||||

|

||||

finetuneフォルダ内のmake_captions.pyを実行します。

|

||||

|

||||

```

|

||||

python finetune\make_captions.py --batch_size <バッチサイズ> <教師データフォルダ>

|

||||

```

|

||||

|

||||

バッチサイズ8、教師データを親フォルダのtrain_dataに置いた場合、以下のようになります。

|

||||

|

||||

```

|

||||

python finetune\make_captions.py --batch_size 8 ..\train_data

|

||||

```

|

||||

|

||||

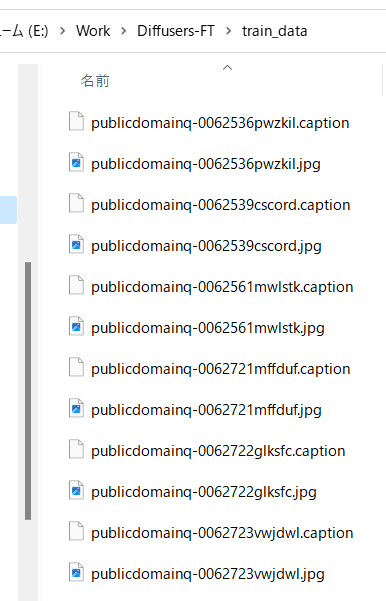

キャプションファイルが教師データ画像と同じディレクトリに、同じファイル名、拡張子.captionで作成されます。

|

||||

|

||||

batch_sizeはGPUのVRAM容量に応じて増減してください。大きいほうが速くなります(VRAM 12GBでももう少し増やせると思います)。

|

||||

max_lengthオプションでキャプションの最大長を指定できます。デフォルトは75です。モデルをトークン長225で学習する場合には長くしても良いかもしれません。

|

||||

caption_extensionオプションでキャプションの拡張子を変更できます。デフォルトは.captionです(.txtにすると後述のDeepDanbooruと競合します)。

|

||||

|

||||

複数の教師データフォルダがある場合には、それぞれのフォルダに対して実行してください。

|

||||

|

||||

なお、推論にランダム性があるため、実行するたびに結果が変わります。固定する場合には--seedオプションで「--seed 42」のように乱数seedを指定してください。

|

||||

|

||||

その他のオプションは--helpでヘルプをご参照ください(パラメータの意味についてはドキュメントがまとまっていないようで、ソースを見るしかないようです)。

|

||||

|

||||

デフォルトでは拡張子.captionでキャプションファイルが生成されます。

|

||||

|

||||

|

||||

|

||||

たとえば以下のようなキャプションが付きます。

|

||||

|

||||

|

||||

|

||||

## DeepDanbooruによるタグ付け

|

||||

danbooruタグのタグ付け自体を行わない場合は「キャプションとタグ情報の前処理」に進んでください。

|

||||

|

||||

タグ付けはDeepDanbooruまたはWD14Taggerで行います。WD14Taggerのほうが精度が良いようです。WD14Taggerでタグ付けする場合は、次の章へ進んでください。

|

||||

|

||||

### 環境整備

|

||||

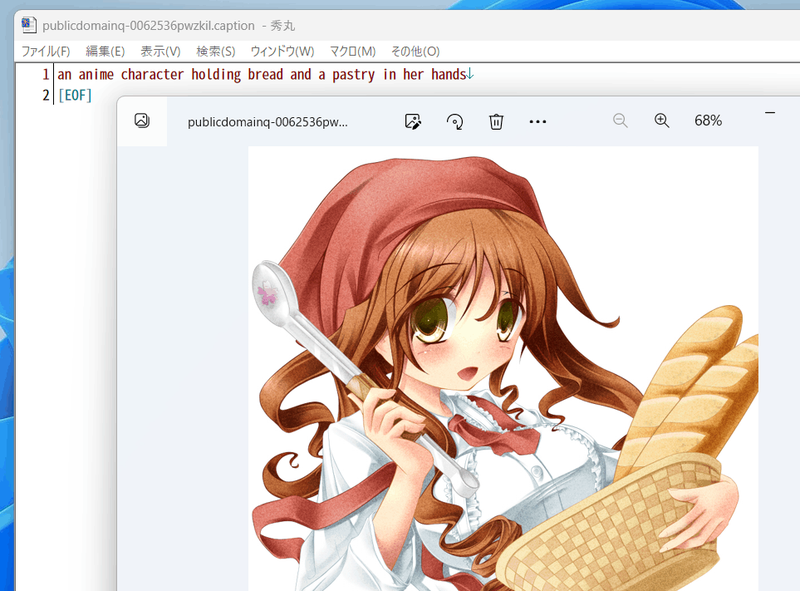

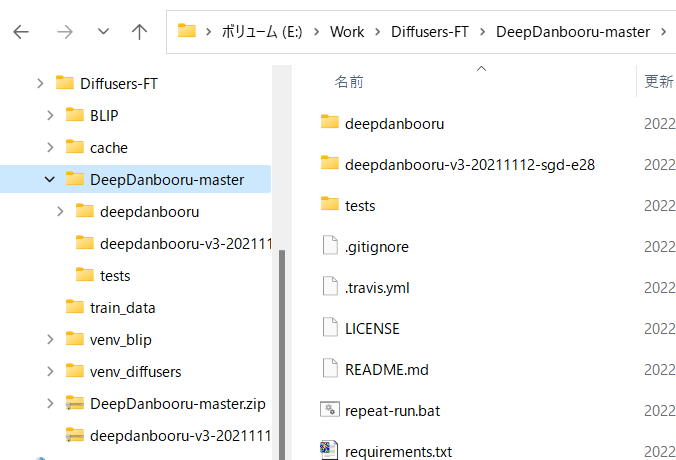

DeepDanbooru https://github.com/KichangKim/DeepDanbooru を作業フォルダにcloneしてくるか、zipをダウンロードして展開します。私はzipで展開しました。

|

||||

またDeepDanbooruのReleasesのページ https://github.com/KichangKim/DeepDanbooru/releases の「DeepDanbooru Pretrained Model v3-20211112-sgd-e28」のAssetsから、deepdanbooru-v3-20211112-sgd-e28.zipをダウンロードしてきてDeepDanbooruのフォルダに展開します。

|

||||

|

||||

以下からダウンロードします。Assetsをクリックして開き、そこからダウンロードします。

|

||||

|

||||

|

||||

|

||||

以下のようなこういうディレクトリ構造にしてください

|

||||

|

||||

|

||||

|

||||

Diffusersの環境に必要なライブラリをインストールします。DeepDanbooruのフォルダに移動してインストールします(実質的にはtensorflow-ioが追加されるだけだと思います)。

|

||||

|

||||

```

|

||||

pip install -r requirements.txt

|

||||

```

|

||||

|

||||

続いてDeepDanbooru自体をインストールします。

|

||||

|

||||

```

|

||||

pip install .

|

||||

```

|

||||

|

||||

以上でタグ付けの環境整備は完了です。

|

||||

|

||||

### タグ付けの実施

|

||||

DeepDanbooruのフォルダに移動し、deepdanbooruを実行してタグ付けを行います。

|

||||

|

||||

```

|

||||

deepdanbooru evaluate <教師データフォルダ> --project-path deepdanbooru-v3-20211112-sgd-e28 --allow-folder --save-txt

|

||||

```

|

||||

|

||||

教師データを親フォルダのtrain_dataに置いた場合、以下のようになります。

|

||||

|

||||

```

|

||||

deepdanbooru evaluate ../train_data --project-path deepdanbooru-v3-20211112-sgd-e28 --allow-folder --save-txt

|

||||

```

|

||||

|

||||

タグファイルが教師データ画像と同じディレクトリに、同じファイル名、拡張子.txtで作成されます。1件ずつ処理されるためわりと遅いです。

|

||||

|

||||

複数の教師データフォルダがある場合には、それぞれのフォルダに対して実行してください。

|

||||

|

||||

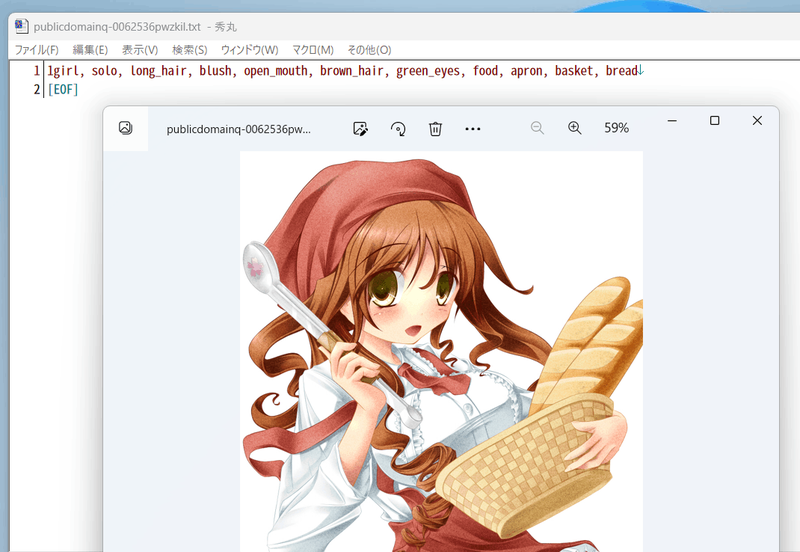

以下のように生成されます。

|

||||

|

||||

|

||||

|

||||

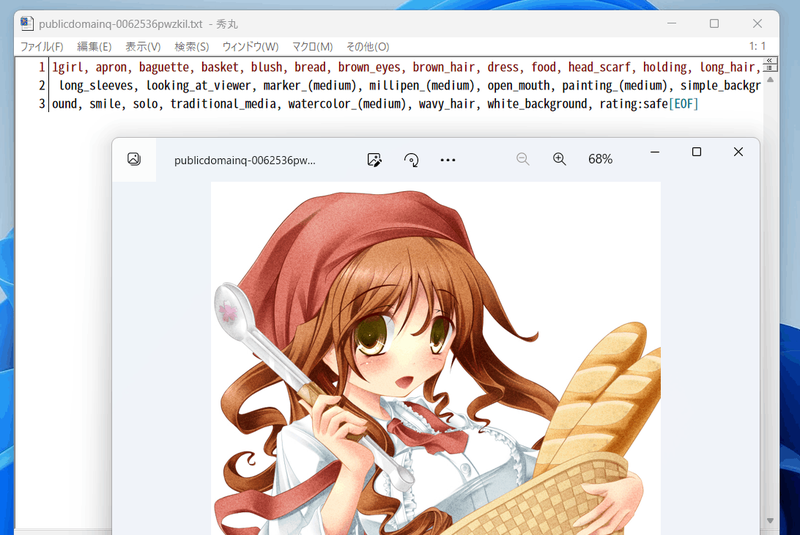

こんな感じにタグが付きます(すごい情報量……)。

|

||||

|

||||

|

||||

|

||||

## WD14Taggerによるタグ付け

|

||||

DeepDanbooruの代わりにWD14Taggerを用いる手順です。

|

||||

|

||||

Automatic1111氏のWebUIで使用しているtaggerを利用します。こちらのgithubページ(https://github.com/toriato/stable-diffusion-webui-wd14-tagger#mrsmilingwolfs-model-aka-waifu-diffusion-14-tagger )の情報を参考にさせていただきました。

|

||||

|

||||

最初の環境整備で必要なモジュールはインストール済みです。また重みはHugging Faceから自動的にダウンロードしてきます。

|

||||

|

||||

### タグ付けの実施

|

||||

スクリプトを実行してタグ付けを行います。

|

||||

```

|

||||

python tag_images_by_wd14_tagger.py --batch_size <バッチサイズ> <教師データフォルダ>

|

||||

```

|

||||

|

||||

教師データを親フォルダのtrain_dataに置いた場合、以下のようになります。

|

||||

```

|

||||

python tag_images_by_wd14_tagger.py --batch_size 4 ..\train_data

|

||||

```

|

||||

|

||||

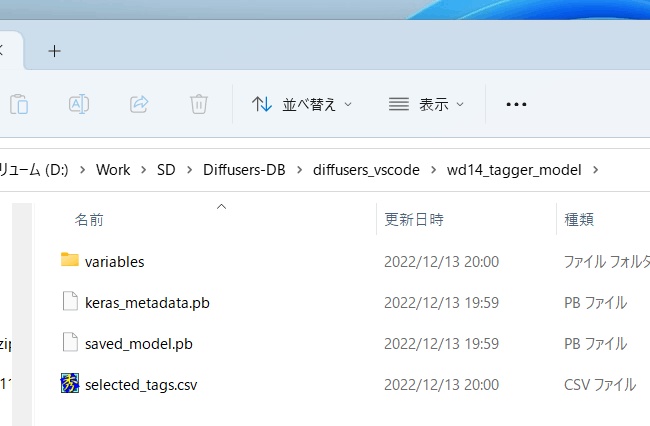

初回起動時にはモデルファイルがwd14_tagger_modelフォルダに自動的にダウンロードされます(フォルダはオプションで変えられます)。以下のようになります。

|

||||

|

||||

|

||||

|

||||

タグファイルが教師データ画像と同じディレクトリに、同じファイル名、拡張子.txtで作成されます。

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

threshオプションで、判定されたタグのconfidence(確信度)がいくつ以上でタグをつけるかが指定できます。デフォルトはWD14Taggerのサンプルと同じ0.35です。値を下げるとより多くのタグが付与されますが、精度は下がります。

|

||||

batch_sizeはGPUのVRAM容量に応じて増減してください。大きいほうが速くなります(VRAM 12GBでももう少し増やせると思います)。caption_extensionオプションでタグファイルの拡張子を変更できます。デフォルトは.txtです。

|

||||

model_dirオプションでモデルの保存先フォルダを指定できます。

|

||||

またforce_downloadオプションを指定すると保存先フォルダがあってもモデルを再ダウンロードします。

|

||||

|

||||

複数の教師データフォルダがある場合には、それぞれのフォルダに対して実行してください。

|

||||

|

||||

## キャプションとタグ情報の前処理

|

||||

|

||||

スクリプトから処理しやすいようにキャプションとタグをメタデータとしてひとつのファイルにまとめます。

|

||||

|

||||

### キャプションの前処理

|

||||

|

||||

キャプションをメタデータに入れるには、作業フォルダ内で以下を実行してください(キャプションを学習に使わない場合は実行不要です)(実際は1行で記述します、以下同様)。

|

||||

|

||||

```

|

||||

python merge_captions_to_metadata.py <教師データフォルダ>

|

||||

--in_json <読み込むメタデータファイル名>

|

||||

<メタデータファイル名>

|

||||

```

|

||||

|

||||

メタデータファイル名は任意の名前です。

|

||||

教師データがtrain_data、読み込むメタデータファイルなし、メタデータファイルがmeta_cap.jsonの場合、以下のようになります。

|

||||

|

||||

```

|

||||

python merge_captions_to_metadata.py train_data meta_cap.json

|

||||

```

|

||||

|

||||

caption_extensionオプションでキャプションの拡張子を指定できます。

|

||||

|

||||

複数の教師データフォルダがある場合には、full_path引数を指定してください(メタデータにフルパスで情報を持つようになります)。そして、それぞれのフォルダに対して実行してください。

|

||||

|

||||

```

|

||||

python merge_captions_to_metadata.py --full_path

|

||||

train_data1 meta_cap1.json

|

||||

python merge_captions_to_metadata.py --full_path --in_json meta_cap1.json

|

||||

train_data2 meta_cap2.json

|

||||

```

|

||||

|

||||

in_jsonを省略すると書き込み先メタデータファイルがあるとそこから読み込み、そこに上書きします。

|

||||

|

||||

__※in_jsonオプションと書き込み先を都度書き換えて、別のメタデータファイルへ書き出すようにすると安全です。__

|

||||

|

||||

### タグの前処理

|

||||

|

||||

同様にタグもメタデータにまとめます(タグを学習に使わない場合は実行不要です)。

|

||||

```

|

||||

python merge_dd_tags_to_metadata.py <教師データフォルダ>

|

||||

--in_json <読み込むメタデータファイル名>

|

||||

<書き込むメタデータファイル名>

|

||||

```

|

||||

|

||||

先と同じディレクトリ構成で、meta_cap.jsonを読み、meta_cap_dd.jsonに書きだす場合、以下となります。

|

||||

```

|

||||

python merge_dd_tags_to_metadata.py train_data --in_json meta_cap.json meta_cap_dd.json

|

||||

```

|

||||

|

||||

複数の教師データフォルダがある場合には、full_path引数を指定してください。そして、それぞれのフォルダに対して実行してください。

|

||||

|

||||

```

|

||||

python merge_dd_tags_to_metadata.py --full_path --in_json meta_cap2.json

|

||||

train_data1 meta_cap_dd1.json

|

||||

python merge_dd_tags_to_metadata.py --full_path --in_json meta_cap_dd1.json

|

||||

train_data2 meta_cap_dd2.json

|

||||

```

|

||||

|

||||

in_jsonを省略すると書き込み先メタデータファイルがあるとそこから読み込み、そこに上書きします。

|

||||

|

||||

__※in_jsonオプションと書き込み先を都度書き換えて、別のメタデータファイルへ書き出すようにすると安全です。__

|

||||

|

||||

### キャプションとタグのクリーニング

|

||||

ここまででメタデータファイルにキャプションとDeepDanbooruのタグがまとめられています。ただ自動キャプショニングにしたキャプションは表記ゆれなどがあり微妙(※)ですし、タグにはアンダースコアが含まれていたりratingが付いていたりしますので(DeepDanbooruの場合)、エディタの置換機能などを用いてキャプションとタグのクリーニングをしたほうがいいでしょう。

|

||||

|

||||

※たとえばアニメ絵の少女を学習する場合、キャプションにはgirl/girls/woman/womenなどのばらつきがあります。また「anime girl」なども単に「girl」としたほうが適切かもしれません。

|

||||

|

||||

クリーニング用のスクリプトが用意してありますので、スクリプトの内容を状況に応じて編集してお使いください。

|

||||

|

||||

(教師データフォルダの指定は不要になりました。メタデータ内の全データをクリーニングします。)

|

||||

|

||||

```

|

||||

python clean_captions_and_tags.py <読み込むメタデータファイル名> <書き込むメタデータファイル名>

|

||||

```

|

||||

|

||||

--in_jsonは付きませんのでご注意ください。たとえば次のようになります。

|

||||

|

||||

```

|

||||

python clean_captions_and_tags.py meta_cap_dd.json meta_clean.json

|

||||

```

|

||||

|

||||

以上でキャプションとタグの前処理は完了です。

|

||||

|

||||

## latentsの事前取得

|

||||

|

||||

学習を高速に進めるためあらかじめ画像の潜在表現を取得しディスクに保存しておきます。あわせてbucketing(教師データをアスペクト比に応じて分類する)を行います。

|

||||

|

||||

作業フォルダで以下のように入力してください。

|

||||

```

|

||||

python prepare_buckets_latents.py <教師データフォルダ>

|

||||

<読み込むメタデータファイル名> <書き込むメタデータファイル名>

|

||||

<fine tuningするモデル名またはcheckpoint>

|

||||

--batch_size <バッチサイズ>

|

||||

--max_resolution <解像度 幅,高さ>

|

||||

--mixed_precision <精度>

|

||||

```

|

||||

|

||||

モデルがmodel.ckpt、バッチサイズ4、学習解像度は512\*512、精度no(float32)で、meta_clean.jsonからメタデータを読み込み、meta_lat.jsonに書き込む場合、以下のようになります。

|

||||

|

||||

```

|

||||

python prepare_buckets_latents.py

|

||||

train_data meta_clean.json meta_lat.json model.ckpt

|

||||

--batch_size 4 --max_resolution 512,512 --mixed_precision no

|

||||

```

|

||||

|

||||

教師データフォルダにnumpyのnpz形式でlatentsが保存されます。

|

||||

|

||||

Stable Diffusion 2.0のモデルを読み込む場合は--v2オプションを指定してください(--v_parameterizationは不要です)。

|

||||

|

||||

解像度の最小サイズを--min_bucket_resoオプションで、最大サイズを--max_bucket_resoで指定できます。デフォルトはそれぞれ256、1024です。たとえば最小サイズに384を指定すると、256\*1024や320\*768などの解像度は使わなくなります。

|

||||

解像度を768\*768のように大きくした場合、最大サイズに1280などを指定すると良いでしょう。

|

||||

|

||||

--flip_augオプションを指定すると左右反転のaugmentation(データ拡張)を行います。疑似的にデータ量を二倍に増やすことができますが、データが左右対称でない場合に指定すると(例えばキャラクタの外見、髪型など)学習がうまく行かなくなります。

|

||||

(反転した画像についてもlatentsを取得し、\*\_flip.npzファイルを保存する単純な実装です。fline_tune.pyには特にオプション指定は必要ありません。\_flip付きのファイルがある場合、flip付き・なしのファイルを、ランダムに読み込みます。)

|

||||

|

||||

バッチサイズはVRAM 12GBでももう少し増やせるかもしれません。

|

||||

解像度は64で割り切れる数字で、"幅,高さ"で指定します。解像度はfine tuning時のメモリサイズに直結します。VRAM 12GBでは512,512が限界と思われます(※)。16GBなら512,704や512,768まで上げられるかもしれません。なお256,256等にしてもVRAM 8GBでは厳しいようです(パラメータやoptimizerなどは解像度に関係せず一定のメモリが必要なため)。

|

||||

|

||||

※batch size 1の学習で12GB VRAM、640,640で動いたとの報告もありました。

|

||||

|

||||

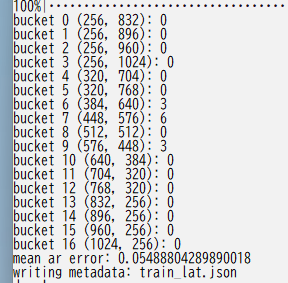

以下のようにbucketingの結果が表示されます。

|

||||

|

||||

|

||||

|

||||

複数の教師データフォルダがある場合には、full_path引数を指定してください。そして、それぞれのフォルダに対して実行してください。

|

||||

```

|

||||

python prepare_buckets_latents.py --full_path

|

||||

train_data1 meta_clean.json meta_lat1.json model.ckpt

|

||||

--batch_size 4 --max_resolution 512,512 --mixed_precision no

|

||||

|

||||

python prepare_buckets_latents.py --full_path

|

||||

train_data2 meta_lat1.json meta_lat2.json model.ckpt

|

||||

--batch_size 4 --max_resolution 512,512 --mixed_precision no

|

||||

|

||||

```

|

||||

読み込み元と書き込み先を同じにすることも可能ですが別々の方が安全です。

|

||||

|

||||

__※引数を都度書き換えて、別のメタデータファイルに書き込むと安全です。__

|

||||

|

||||

|

||||

## 学習の実行

|

||||

たとえば以下のように実行します。以下は省メモリ化のための設定です。

|

||||

```

|

||||

accelerate launch --num_cpu_threads_per_process 8 fine_tune.py

|

||||

--pretrained_model_name_or_path=model.ckpt

|

||||

--in_json meta_lat.json

|

||||

--train_data_dir=train_data

|

||||

--output_dir=fine_tuned

|

||||

--shuffle_caption

|

||||

--train_batch_size=1 --learning_rate=5e-6 --max_train_steps=10000

|

||||

--use_8bit_adam --xformers --gradient_checkpointing

|

||||

--mixed_precision=bf16

|

||||

--save_every_n_epochs=4

|

||||

```

|

||||

|

||||

accelerateのnum_cpu_threads_per_processにはCPUのコア数を指定するとよいようです。

|

||||

|

||||

pretrained_model_name_or_pathに学習対象のモデルを指定します(Stable DiffusionのcheckpointかDiffusersのモデル)。Stable Diffusionのcheckpointは.ckptと.safetensorsに対応しています(拡張子で自動判定)。

|

||||

|

||||

in_jsonにlatentをキャッシュしたときのメタデータファイルを指定します。

|

||||

|

||||

train_data_dirに教師データのフォルダを、output_dirに学習後のモデルの出力先フォルダを指定します。

|

||||

|

||||

shuffle_captionを指定すると、キャプション、タグをカンマ区切りされた単位でシャッフルして学習します(Waifu Diffusion v1.3で行っている手法です)。

|

||||

(先頭のトークンのいくつかをシャッフルせずに固定できます。その他のオプションのkeep_tokensをご覧ください。)

|

||||

|

||||

train_batch_sizeにバッチサイズを指定します。VRAM 12GBでは1か2程度を指定してください。解像度によっても指定可能な数は変わってきます。

|

||||

学習に使用される実際のデータ量は「バッチサイズ×ステップ数」です。バッチサイズを増やした時には、それに応じてステップ数を下げることが可能です。

|

||||

|

||||

learning_rateに学習率を指定します。たとえばWaifu Diffusion v1.3は5e-6のようです。

|

||||

max_train_stepsにステップ数を指定します。

|

||||

|

||||

use_8bit_adamを指定すると8-bit Adam Optimizerを使用します。省メモリ化、高速化されますが精度は下がる可能性があります。

|

||||

|

||||

xformersを指定するとCrossAttentionを置換して省メモリ化、高速化します。

|

||||

※11/9時点ではfloat32の学習ではxformersがエラーになるため、bf16/fp16を使うか、代わりにmem_eff_attnを指定して省メモリ版CrossAttentionを使ってください(速度はxformersに劣ります)。

|

||||

|

||||

gradient_checkpointingで勾配の途中保存を有効にします。速度は遅くなりますが使用メモリ量が減ります。

|

||||

|

||||

mixed_precisionで混合精度を使うか否かを指定します。"fp16"または"bf16"を指定すると省メモリになりますが精度は劣ります。

|

||||

"fp16"と"bf16"は使用メモリ量はほぼ同じで、bf16の方が学習結果は良くなるとの話もあります(試した範囲ではあまり違いは感じられませんでした)。

|

||||

"no"を指定すると使用しません(float32になります)。

|

||||

|

||||

※bf16で学習したcheckpointをAUTOMATIC1111氏のWeb UIで読み込むとエラーになるようです。これはデータ型のbfloat16がWeb UIのモデルsafety checkerでエラーとなるためのようです。save_precisionオプションを指定してfp16またはfloat32形式で保存してください。またはsafetensors形式で保管しても良さそうです。

|

||||

|

||||

save_every_n_epochsを指定するとそのエポックだけ経過するたびに学習中のモデルを保存します。

|

||||

|

||||

### Stable Diffusion 2.0対応

|

||||

Hugging Faceのstable-diffusion-2-baseを使う場合は--v2オプションを、stable-diffusion-2または768-v-ema.ckptを使う場合は--v2と--v_parameterizationの両方のオプションを指定してください。

|

||||

|

||||

### メモリに余裕がある場合に精度や速度を上げる

|

||||

まずgradient_checkpointingを外すと速度が上がります。ただし設定できるバッチサイズが減りますので、精度と速度のバランスを見ながら設定してください。

|

||||

|

||||

バッチサイズを増やすと速度、精度が上がります。メモリが足りる範囲で、1データ当たりの速度を確認しながら増やしてください(メモリがぎりぎりになるとかえって速度が落ちることがあります)。

|

||||

|

||||

### 使用するCLIP出力の変更

|

||||

clip_skipオプションに2を指定すると、後ろから二番目の層の出力を用います。1またはオプション省略時は最後の層を用います。

|

||||

学習したモデルはAutomatic1111氏のWeb UIで推論できるはずです。

|

||||

|

||||

※SD2.0はデフォルトで後ろから二番目の層を使うため、SD2.0の学習では指定しないでください。

|

||||

|

||||

学習対象のモデルがもともと二番目の層を使うように学習されている場合は、2を指定するとよいでしょう。

|

||||

|

||||

そうではなく最後の層を使用していた場合はモデル全体がそれを前提に学習されています。そのため改めて二番目の層を使用して学習すると、望ましい学習結果を得るにはある程度の枚数の教師データ、長めの学習が必要になるかもしれません。

|

||||

|

||||

### トークン長の拡張

|

||||

max_token_lengthに150または225を指定することでトークン長を拡張して学習できます。

|

||||

学習したモデルはAutomatic1111氏のWeb UIで推論できるはずです。

|

||||

|

||||

clip_skipと同様に、モデルの学習状態と異なる長さで学習するには、ある程度の教師データ枚数、長めの学習時間が必要になると思われます。

|

||||

|

||||

### 学習ログの保存

|

||||

logging_dirオプションにログ保存先フォルダを指定してください。TensorBoard形式のログが保存されます。

|

||||

|

||||

たとえば--logging_dir=logsと指定すると、作業フォルダにlogsフォルダが作成され、その中の日時フォルダにログが保存されます。

|

||||

また--log_prefixオプションを指定すると、日時の前に指定した文字列が追加されます。「--logging_dir=logs --log_prefix=fine_tune_style1」などとして識別用にお使いください。

|

||||

|

||||

TensorBoardでログを確認するには、別のコマンドプロンプトを開き、作業フォルダで以下のように入力します(tensorboardはDiffusersのインストール時にあわせてインストールされると思いますが、もし入っていないならpip install tensorboardで入れてください)。

|

||||

```

|

||||

tensorboard --logdir=logs

|

||||

```

|

||||

|

||||

### Hypernetworkの学習

|

||||

別の記事で解説予定です。

|

||||

|

||||

### 勾配をfp16とした学習(実験的機能)

|

||||

full_fp16オプションを指定すると勾配を通常のfloat32からfloat16(fp16)に変更して学習します(mixed precisionではなく完全なfp16学習になるようです)。これによりSD1.xの512*512サイズでは8GB未満、SD2.xの512*512サイズで12GB未満のVRAM使用量で学習できるようです。

|

||||

|

||||

あらかじめaccelerate configでfp16を指定し、オプションでmixed_precision="fp16"としてください(bf16では動作しません)。

|

||||

|

||||

メモリ使用量を最小化するためには、xformers、use_8bit_adam、gradient_checkpointingの各オプションを指定し、train_batch_sizeを1としてください。

|

||||

(余裕があるようならtrain_batch_sizeを段階的に増やすと若干精度が上がるはずです。)

|

||||

|

||||

PyTorchのソースにパッチを当てて無理やり実現しています(PyTorch 1.12.1と1.13.0で確認)。精度はかなり落ちますし、途中で学習失敗する確率も高くなります。学習率やステップ数の設定もシビアなようです。それらを認識したうえで自己責任でお使いください。

|

||||

|

||||

### その他のオプション

|

||||

|

||||

#### keep_tokens

|

||||

数値を指定するとキャプションの先頭から、指定した数だけのトークン(カンマ区切りの文字列)をシャッフルせず固定します。

|

||||

|

||||

キャプションとタグが両方ある場合、学習時のプロンプトは「キャプション,タグ1,タグ2……」のように連結されますので、「--keep_tokens=1」とすれば、学習時にキャプションが必ず先頭に来るようになります。

|

||||

|

||||

#### dataset_repeats

|

||||

データセットの枚数が極端に少ない場合、epochがすぐに終わってしまうため(epochの区切りで少し時間が掛かります)、数値を指定してデータを何倍かしてepochを長めにしてください。

|

||||

|

||||

#### train_text_encoder

|

||||

Text Encoderも学習対象とします。メモリ使用量が若干増加します。

|

||||

|

||||

通常のfine tuningではText Encoderは学習対象としませんが(恐らくText Encoderの出力に従うようにU-Netを学習するため)、学習データ数が少ない場合には、DreamBoothのようにText Encoder側に学習させるのも有効的なようです。

|

||||

|

||||

#### save_precision

|

||||

checkpoint保存時のデータ形式をfloat、fp16、bf16から指定できます(未指定時は学習中のデータ形式と同じ)。ディスク容量が節約できますがモデルによる生成結果は変わってきます。またfloatやfp16を指定すると、1111氏のWeb UIでも読めるようになるはずです。

|

||||

|

||||

※VAEについては元のcheckpointのデータ形式のままになりますので、fp16でもモデルサイズが2GB強まで小さくならない場合があります。

|

||||

|

||||

#### save_model_as

|

||||

モデルの保存形式を指定します。ckpt、safetensors、diffusers、diffusers_safetensorsのいずれかを指定してください。

|

||||

|

||||

Stable Diffusion形式(ckptまたはsafetensors)を読み込み、Diffusers形式で保存する場合、不足する情報はHugging Faceからv1.5またはv2.1の情報を落としてきて補完します。

|

||||

|

||||

#### use_safetensors

|

||||

このオプションを指定するとsafetensors形式でcheckpointを保存します。保存形式はデフォルト(読み込んだ形式と同じ)になります。

|

||||

|

||||

#### save_stateとresume

|

||||

save_stateオプションで、途中保存時および最終保存時に、checkpointに加えてoptimizer等の学習状態をフォルダに保存します。これにより中断してから学習再開したときの精度低下が避けられます(optimizerは状態を持ちながら最適化をしていくため、その状態がリセットされると再び初期状態から最適化を行わなくてはなりません)。なお、Accelerateの仕様でステップ数は保存されません。

|

||||

|

||||

スクリプト起動時、resumeオプションで状態の保存されたフォルダを指定すると再開できます。

|

||||

|

||||

学習状態は一回の保存あたり5GB程度になりますのでディスク容量にご注意ください。

|

||||

|

||||

#### gradient_accumulation_steps

|

||||

指定したステップ数だけまとめて勾配を更新します。バッチサイズを増やすのと同様の効果がありますが、メモリを若干消費します。

|

||||

|

||||

※Accelerateの仕様で学習モデルが複数の場合には対応していないとのことですので、Text Encoderを学習対象にして、このオプションに2以上の値を指定するとエラーになるかもしれません。

|

||||

|

||||

#### lr_scheduler / lr_warmup_steps

|

||||

lr_schedulerオプションで学習率のスケジューラをlinear, cosine, cosine_with_restarts, polynomial, constant, constant_with_warmupから選べます。デフォルトはconstantです。

|

||||

|

||||

lr_warmup_stepsでスケジューラのウォームアップ(だんだん学習率を変えていく)ステップ数を指定できます。詳細については各自お調べください。

|

||||

|

||||

#### diffusers_xformers

|

||||

スクリプト独自のxformers置換機能ではなくDiffusersのxformers機能を利用します。Hypernetworkの学習はできなくなります。

|

||||

240

finetune/blip/blip.py

Normal file

240

finetune/blip/blip.py

Normal file

@@ -0,0 +1,240 @@

|

||||

'''

|

||||

* Copyright (c) 2022, salesforce.com, inc.

|

||||

* All rights reserved.

|

||||

* SPDX-License-Identifier: BSD-3-Clause

|

||||

* For full license text, see LICENSE.txt file in the repo root or https://opensource.org/licenses/BSD-3-Clause

|

||||

* By Junnan Li

|

||||

'''

|

||||

import warnings

|

||||

warnings.filterwarnings("ignore")

|

||||

|

||||

# from models.vit import VisionTransformer, interpolate_pos_embed

|

||||

# from models.med import BertConfig, BertModel, BertLMHeadModel

|

||||

from blip.vit import VisionTransformer, interpolate_pos_embed

|

||||

from blip.med import BertConfig, BertModel, BertLMHeadModel

|

||||

from transformers import BertTokenizer

|

||||

|

||||

import torch

|

||||

from torch import nn

|

||||

import torch.nn.functional as F

|

||||

|

||||

import os

|

||||

from urllib.parse import urlparse

|

||||

from timm.models.hub import download_cached_file

|

||||

|

||||

class BLIP_Base(nn.Module):

|

||||

def __init__(self,

|

||||

med_config = 'configs/med_config.json',

|

||||

image_size = 224,

|

||||

vit = 'base',

|

||||

vit_grad_ckpt = False,

|

||||

vit_ckpt_layer = 0,

|

||||

):

|

||||

"""

|

||||

Args:

|

||||

med_config (str): path for the mixture of encoder-decoder model's configuration file

|

||||

image_size (int): input image size

|

||||

vit (str): model size of vision transformer

|

||||

"""

|

||||

super().__init__()

|

||||

|

||||

self.visual_encoder, vision_width = create_vit(vit,image_size, vit_grad_ckpt, vit_ckpt_layer)

|

||||

self.tokenizer = init_tokenizer()

|

||||

med_config = BertConfig.from_json_file(med_config)

|

||||

med_config.encoder_width = vision_width

|

||||

self.text_encoder = BertModel(config=med_config, add_pooling_layer=False)

|

||||

|

||||

|

||||

def forward(self, image, caption, mode):

|

||||

|

||||

assert mode in ['image', 'text', 'multimodal'], "mode parameter must be image, text, or multimodal"

|

||||

text = self.tokenizer(caption, return_tensors="pt").to(image.device)

|

||||

|

||||

if mode=='image':

|

||||

# return image features

|

||||

image_embeds = self.visual_encoder(image)

|

||||

return image_embeds

|

||||

|

||||

elif mode=='text':

|

||||

# return text features

|

||||

text_output = self.text_encoder(text.input_ids, attention_mask = text.attention_mask,

|

||||

return_dict = True, mode = 'text')

|

||||

return text_output.last_hidden_state

|

||||

|

||||

elif mode=='multimodal':

|

||||

# return multimodel features

|

||||

image_embeds = self.visual_encoder(image)

|

||||

image_atts = torch.ones(image_embeds.size()[:-1],dtype=torch.long).to(image.device)

|

||||

|

||||

text.input_ids[:,0] = self.tokenizer.enc_token_id

|

||||

output = self.text_encoder(text.input_ids,

|

||||

attention_mask = text.attention_mask,

|

||||

encoder_hidden_states = image_embeds,

|

||||

encoder_attention_mask = image_atts,

|

||||

return_dict = True,

|

||||

)

|

||||

return output.last_hidden_state

|

||||

|

||||

|

||||

|

||||

class BLIP_Decoder(nn.Module):

|

||||

def __init__(self,

|

||||

med_config = 'configs/med_config.json',

|

||||

image_size = 384,

|

||||

vit = 'base',

|

||||

vit_grad_ckpt = False,

|

||||

vit_ckpt_layer = 0,

|

||||

prompt = 'a picture of ',

|

||||

):

|

||||

"""

|

||||

Args:

|

||||

med_config (str): path for the mixture of encoder-decoder model's configuration file

|

||||

image_size (int): input image size

|

||||

vit (str): model size of vision transformer

|

||||

"""

|

||||

super().__init__()

|

||||

|

||||

self.visual_encoder, vision_width = create_vit(vit,image_size, vit_grad_ckpt, vit_ckpt_layer)

|

||||

self.tokenizer = init_tokenizer()

|

||||

med_config = BertConfig.from_json_file(med_config)

|

||||

med_config.encoder_width = vision_width

|

||||

self.text_decoder = BertLMHeadModel(config=med_config)

|

||||

|

||||

self.prompt = prompt

|

||||

self.prompt_length = len(self.tokenizer(self.prompt).input_ids)-1

|

||||

|

||||

|

||||

def forward(self, image, caption):

|

||||

|

||||

image_embeds = self.visual_encoder(image)

|

||||

image_atts = torch.ones(image_embeds.size()[:-1],dtype=torch.long).to(image.device)

|

||||

|

||||

text = self.tokenizer(caption, padding='longest', truncation=True, max_length=40, return_tensors="pt").to(image.device)

|

||||

|

||||

text.input_ids[:,0] = self.tokenizer.bos_token_id

|

||||

|

||||

decoder_targets = text.input_ids.masked_fill(text.input_ids == self.tokenizer.pad_token_id, -100)

|

||||

decoder_targets[:,:self.prompt_length] = -100

|

||||

|

||||

decoder_output = self.text_decoder(text.input_ids,

|

||||

attention_mask = text.attention_mask,

|

||||

encoder_hidden_states = image_embeds,

|

||||

encoder_attention_mask = image_atts,

|

||||

labels = decoder_targets,

|

||||

return_dict = True,

|

||||

)

|

||||

loss_lm = decoder_output.loss

|

||||

|

||||

return loss_lm

|

||||

|

||||

def generate(self, image, sample=False, num_beams=3, max_length=30, min_length=10, top_p=0.9, repetition_penalty=1.0):

|

||||

image_embeds = self.visual_encoder(image)

|

||||

|

||||

if not sample:

|

||||

image_embeds = image_embeds.repeat_interleave(num_beams,dim=0)

|

||||

|

||||

image_atts = torch.ones(image_embeds.size()[:-1],dtype=torch.long).to(image.device)

|

||||

model_kwargs = {"encoder_hidden_states": image_embeds, "encoder_attention_mask":image_atts}

|

||||

|

||||

prompt = [self.prompt] * image.size(0)

|

||||

input_ids = self.tokenizer(prompt, return_tensors="pt").input_ids.to(image.device)

|

||||

input_ids[:,0] = self.tokenizer.bos_token_id

|

||||

input_ids = input_ids[:, :-1]

|

||||

|

||||

if sample:

|

||||

#nucleus sampling

|

||||

outputs = self.text_decoder.generate(input_ids=input_ids,

|

||||

max_length=max_length,

|

||||

min_length=min_length,

|

||||

do_sample=True,

|

||||

top_p=top_p,

|

||||

num_return_sequences=1,

|

||||

eos_token_id=self.tokenizer.sep_token_id,

|

||||

pad_token_id=self.tokenizer.pad_token_id,

|

||||

repetition_penalty=1.1,

|

||||

**model_kwargs)

|

||||

else:

|

||||

#beam search

|

||||

outputs = self.text_decoder.generate(input_ids=input_ids,

|

||||

max_length=max_length,

|

||||

min_length=min_length,

|

||||

num_beams=num_beams,

|

||||

eos_token_id=self.tokenizer.sep_token_id,

|

||||

pad_token_id=self.tokenizer.pad_token_id,

|

||||

repetition_penalty=repetition_penalty,

|

||||

**model_kwargs)

|

||||

|

||||

captions = []

|

||||

for output in outputs:

|

||||

caption = self.tokenizer.decode(output, skip_special_tokens=True)

|

||||

captions.append(caption[len(self.prompt):])

|

||||

return captions

|

||||

|

||||

|

||||

def blip_decoder(pretrained='',**kwargs):

|

||||

model = BLIP_Decoder(**kwargs)

|

||||

if pretrained:

|

||||

model,msg = load_checkpoint(model,pretrained)

|

||||

assert(len(msg.missing_keys)==0)

|

||||

return model

|

||||

|

||||

def blip_feature_extractor(pretrained='',**kwargs):

|

||||

model = BLIP_Base(**kwargs)

|

||||

if pretrained:

|

||||

model,msg = load_checkpoint(model,pretrained)

|

||||

assert(len(msg.missing_keys)==0)

|

||||

return model

|

||||

|

||||

def init_tokenizer():

|

||||

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

|

||||

tokenizer.add_special_tokens({'bos_token':'[DEC]'})

|

||||

tokenizer.add_special_tokens({'additional_special_tokens':['[ENC]']})

|

||||

tokenizer.enc_token_id = tokenizer.additional_special_tokens_ids[0]

|

||||

return tokenizer

|

||||

|

||||

|

||||

def create_vit(vit, image_size, use_grad_checkpointing=False, ckpt_layer=0, drop_path_rate=0):

|

||||

|

||||

assert vit in ['base', 'large'], "vit parameter must be base or large"

|

||||

if vit=='base':

|

||||

vision_width = 768

|

||||

visual_encoder = VisionTransformer(img_size=image_size, patch_size=16, embed_dim=vision_width, depth=12,

|

||||

num_heads=12, use_grad_checkpointing=use_grad_checkpointing, ckpt_layer=ckpt_layer,

|

||||

drop_path_rate=0 or drop_path_rate

|

||||

)

|

||||

elif vit=='large':

|

||||

vision_width = 1024

|

||||

visual_encoder = VisionTransformer(img_size=image_size, patch_size=16, embed_dim=vision_width, depth=24,

|

||||

num_heads=16, use_grad_checkpointing=use_grad_checkpointing, ckpt_layer=ckpt_layer,

|

||||

drop_path_rate=0.1 or drop_path_rate

|

||||

)

|

||||

return visual_encoder, vision_width

|

||||

|

||||

def is_url(url_or_filename):

|

||||

parsed = urlparse(url_or_filename)

|

||||

return parsed.scheme in ("http", "https")

|

||||

|

||||

def load_checkpoint(model,url_or_filename):

|

||||

if is_url(url_or_filename):

|

||||

cached_file = download_cached_file(url_or_filename, check_hash=False, progress=True)

|

||||

checkpoint = torch.load(cached_file, map_location='cpu')

|

||||

elif os.path.isfile(url_or_filename):

|

||||

checkpoint = torch.load(url_or_filename, map_location='cpu')

|

||||

else:

|

||||

raise RuntimeError('checkpoint url or path is invalid')

|

||||

|

||||

state_dict = checkpoint['model']

|

||||

|

||||

state_dict['visual_encoder.pos_embed'] = interpolate_pos_embed(state_dict['visual_encoder.pos_embed'],model.visual_encoder)

|

||||

if 'visual_encoder_m.pos_embed' in model.state_dict().keys():

|

||||

state_dict['visual_encoder_m.pos_embed'] = interpolate_pos_embed(state_dict['visual_encoder_m.pos_embed'],

|

||||

model.visual_encoder_m)

|

||||

for key in model.state_dict().keys():

|

||||

if key in state_dict.keys():

|

||||

if state_dict[key].shape!=model.state_dict()[key].shape:

|

||||

del state_dict[key]

|

||||

|

||||

msg = model.load_state_dict(state_dict,strict=False)

|

||||

print('load checkpoint from %s'%url_or_filename)

|

||||

return model,msg

|

||||

|

||||

955

finetune/blip/med.py

Normal file

955

finetune/blip/med.py

Normal file

@@ -0,0 +1,955 @@

|

||||

'''

|

||||

* Copyright (c) 2022, salesforce.com, inc.

|

||||

* All rights reserved.

|

||||

* SPDX-License-Identifier: BSD-3-Clause

|

||||

* For full license text, see LICENSE.txt file in the repo root or https://opensource.org/licenses/BSD-3-Clause

|

||||

* By Junnan Li

|

||||

* Based on huggingface code base

|

||||

* https://github.com/huggingface/transformers/blob/v4.15.0/src/transformers/models/bert

|

||||

'''

|

||||

|

||||

import math

|

||||

import os

|

||||

import warnings

|

||||

from dataclasses import dataclass

|

||||

from typing import Optional, Tuple

|

||||

|

||||

import torch

|

||||

from torch import Tensor, device, dtype, nn

|

||||

import torch.utils.checkpoint

|

||||

from torch import nn

|

||||

from torch.nn import CrossEntropyLoss

|

||||

import torch.nn.functional as F

|

||||

|

||||

from transformers.activations import ACT2FN

|

||||

from transformers.file_utils import (

|

||||

ModelOutput,

|

||||

)

|

||||

from transformers.modeling_outputs import (

|

||||

BaseModelOutputWithPastAndCrossAttentions,

|

||||

BaseModelOutputWithPoolingAndCrossAttentions,

|

||||

CausalLMOutputWithCrossAttentions,

|

||||

MaskedLMOutput,

|

||||

MultipleChoiceModelOutput,

|

||||

NextSentencePredictorOutput,

|

||||

QuestionAnsweringModelOutput,

|

||||

SequenceClassifierOutput,

|

||||

TokenClassifierOutput,

|

||||

)

|

||||

from transformers.modeling_utils import (

|

||||

PreTrainedModel,

|

||||

apply_chunking_to_forward,

|

||||

find_pruneable_heads_and_indices,

|

||||

prune_linear_layer,

|

||||

)

|

||||

from transformers.utils import logging

|

||||

from transformers.models.bert.configuration_bert import BertConfig

|

||||

|

||||

|

||||

logger = logging.get_logger(__name__)

|

||||

|

||||

|

||||

class BertEmbeddings(nn.Module):

|

||||

"""Construct the embeddings from word and position embeddings."""

|

||||

|

||||

def __init__(self, config):

|

||||

super().__init__()

|

||||

self.word_embeddings = nn.Embedding(config.vocab_size, config.hidden_size, padding_idx=config.pad_token_id)

|

||||

self.position_embeddings = nn.Embedding(config.max_position_embeddings, config.hidden_size)

|

||||

|

||||

# self.LayerNorm is not snake-cased to stick with TensorFlow model variable name and be able to load

|

||||

# any TensorFlow checkpoint file

|

||||

self.LayerNorm = nn.LayerNorm(config.hidden_size, eps=config.layer_norm_eps)

|

||||

self.dropout = nn.Dropout(config.hidden_dropout_prob)

|

||||

|

||||

# position_ids (1, len position emb) is contiguous in memory and exported when serialized

|

||||

self.register_buffer("position_ids", torch.arange(config.max_position_embeddings).expand((1, -1)))

|

||||

self.position_embedding_type = getattr(config, "position_embedding_type", "absolute")

|

||||

|

||||

self.config = config

|

||||

|

||||

def forward(

|

||||

self, input_ids=None, position_ids=None, inputs_embeds=None, past_key_values_length=0

|

||||

):

|

||||

if input_ids is not None:

|

||||

input_shape = input_ids.size()

|

||||

else:

|

||||

input_shape = inputs_embeds.size()[:-1]

|

||||

|

||||

seq_length = input_shape[1]

|

||||

|

||||

if position_ids is None:

|

||||

position_ids = self.position_ids[:, past_key_values_length : seq_length + past_key_values_length]

|

||||

|

||||

if inputs_embeds is None:

|

||||

inputs_embeds = self.word_embeddings(input_ids)

|

||||

|

||||

embeddings = inputs_embeds

|

||||

|

||||

if self.position_embedding_type == "absolute":

|

||||

position_embeddings = self.position_embeddings(position_ids)

|

||||

embeddings += position_embeddings

|

||||

embeddings = self.LayerNorm(embeddings)

|

||||

embeddings = self.dropout(embeddings)

|

||||

return embeddings

|

||||

|

||||

|

||||

class BertSelfAttention(nn.Module):

|

||||

def __init__(self, config, is_cross_attention):

|

||||

super().__init__()

|

||||

self.config = config

|

||||

if config.hidden_size % config.num_attention_heads != 0 and not hasattr(config, "embedding_size"):

|

||||

raise ValueError(

|

||||

"The hidden size (%d) is not a multiple of the number of attention "

|

||||

"heads (%d)" % (config.hidden_size, config.num_attention_heads)

|

||||

)

|

||||

|

||||

self.num_attention_heads = config.num_attention_heads

|

||||

self.attention_head_size = int(config.hidden_size / config.num_attention_heads)

|

||||

self.all_head_size = self.num_attention_heads * self.attention_head_size

|

||||

|

||||

self.query = nn.Linear(config.hidden_size, self.all_head_size)

|

||||

if is_cross_attention:

|

||||

self.key = nn.Linear(config.encoder_width, self.all_head_size)

|

||||

self.value = nn.Linear(config.encoder_width, self.all_head_size)

|

||||

else:

|

||||

self.key = nn.Linear(config.hidden_size, self.all_head_size)

|

||||

self.value = nn.Linear(config.hidden_size, self.all_head_size)

|

||||

|

||||

self.dropout = nn.Dropout(config.attention_probs_dropout_prob)

|

||||

self.position_embedding_type = getattr(config, "position_embedding_type", "absolute")

|

||||

if self.position_embedding_type == "relative_key" or self.position_embedding_type == "relative_key_query":

|

||||

self.max_position_embeddings = config.max_position_embeddings

|

||||

self.distance_embedding = nn.Embedding(2 * config.max_position_embeddings - 1, self.attention_head_size)

|

||||

self.save_attention = False

|

||||

|

||||

def save_attn_gradients(self, attn_gradients):

|

||||

self.attn_gradients = attn_gradients

|

||||

|

||||

def get_attn_gradients(self):

|

||||

return self.attn_gradients

|

||||

|

||||

def save_attention_map(self, attention_map):

|

||||

self.attention_map = attention_map

|

||||

|

||||

def get_attention_map(self):

|

||||

return self.attention_map

|

||||

|

||||

def transpose_for_scores(self, x):

|

||||

new_x_shape = x.size()[:-1] + (self.num_attention_heads, self.attention_head_size)

|

||||

x = x.view(*new_x_shape)

|

||||

return x.permute(0, 2, 1, 3)

|

||||

|

||||

def forward(

|

||||

self,

|

||||

hidden_states,

|

||||

attention_mask=None,

|

||||

head_mask=None,

|

||||

encoder_hidden_states=None,

|

||||

encoder_attention_mask=None,

|

||||

past_key_value=None,

|

||||

output_attentions=False,

|

||||

):

|

||||

mixed_query_layer = self.query(hidden_states)

|

||||

|

||||

# If this is instantiated as a cross-attention module, the keys

|

||||

# and values come from an encoder; the attention mask needs to be

|

||||

# such that the encoder's padding tokens are not attended to.

|

||||

is_cross_attention = encoder_hidden_states is not None

|

||||

|

||||

if is_cross_attention:

|

||||

key_layer = self.transpose_for_scores(self.key(encoder_hidden_states))

|

||||

value_layer = self.transpose_for_scores(self.value(encoder_hidden_states))

|

||||

attention_mask = encoder_attention_mask

|

||||

elif past_key_value is not None:

|

||||

key_layer = self.transpose_for_scores(self.key(hidden_states))

|

||||